-

1. 匿名 2025/10/16(木) 12:42:10

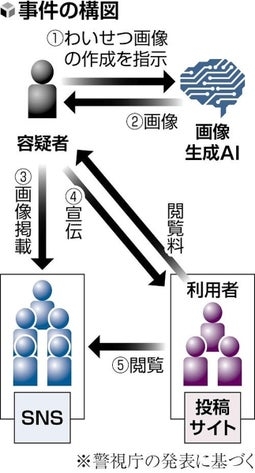

発表によると、会社員の男は1~6月、女優3人に酷似したわいせつ画像計3点をSNSに掲載し、不特定多数が閲覧できるようにした疑い。調べに「女性芸能人を模した画像は閲覧者からの反響が大きく、人気があった。多くの収益を見込めると思った」と容疑を認めている。+4

-29

-

2. 匿名 2025/10/16(木) 12:43:00

なんでこんなこと思いつくんだろう+44

-3

-

3. 匿名 2025/10/16(木) 12:43:28

AIと本物の区別がつかなくなってきてる+82

-1

-

4. 匿名 2025/10/16(木) 12:44:00

どついう指示で書かせてるのか教えてほしいわ+8

-4

-

5. 匿名 2025/10/16(木) 12:44:02

YouTubeもだけど、SNSで収益化出来るようになってからこんなの増えた気がする

もう収益化を制限した方がいい+90

-0

-

6. 匿名 2025/10/16(木) 12:44:19

素晴らしい技術を必ず馬鹿な事やエロに活用する愚か者が発生するよね😩+19

-1

-

7. 匿名 2025/10/16(木) 12:44:30

エロは金になるんだろうね

男はどうしようもないね+64

-3

-

8. 匿名 2025/10/16(木) 12:44:35

本物みたいにできてしまう時代だもんな。+19

-1

-

9. 匿名 2025/10/16(木) 12:44:59

>>2

思い付いても捕まること考えたら下手なことできない+10

-0

-

10. 匿名 2025/10/16(木) 12:45:18

そんなので120万も稼げるんか…+11

-0

-

11. 匿名 2025/10/16(木) 12:45:21

30年前からアイコラというものがあったじゃないか。AIになってよりリアルになってしまったのね。+46

-0

-

12. 匿名 2025/10/16(木) 12:45:49

>会社員の男は自宅のパソコンで、インターネットに無料で公開されている画像生成AIに女優やアイドルらの画像データを学習させ、本人に酷似したわいせつ画像を作成。クリエイターらが作品を投稿する会員制の有料サイトにサンプル画像を掲示し、わいせつ画像を公開していた自身のSNSへのアクセス権を与えていた。

学習させる能力には長けてたのか…+2

-1

-

13. 匿名 2025/10/16(木) 12:45:52

>>4

自前のパソコンで演算するらしいよ

ChatGPTとかは流石にロックかけられている+6

-0

-

14. 匿名 2025/10/16(木) 12:45:53

ほんまに怖い普通に子供や自分の顔をSNSに出してる人も勝手に生成されてばら撒かれる可能性るってことだよね+35

-1

-

15. 匿名 2025/10/16(木) 12:46:13

刑罰を重くしないと今後爆増するでしょうね+24

-0

-

16. 匿名 2025/10/16(木) 12:46:37

男性アイドルと自分がキスしてるAI動画作成してるオタクは逮捕されないの?+16

-4

-

17. 匿名 2025/10/16(木) 12:47:02

本当気持ち悪い

ドルオタが自分とアイドルがキスしてるのAIで作ってSNSにあげててアイドルに同情した+13

-2

-

18. 匿名 2025/10/16(木) 12:47:08

SNSで収益が得られる仕組み無くして欲しい。+10

-0

-

19. 匿名 2025/10/16(木) 12:47:32

>>14

現に今、

卒業アルバムから勝手にAVデビューさせられる事案起きてるしな+24

-1

-

20. 匿名 2025/10/16(木) 12:48:40

動画見てたらどう見ても

顔がAIじゃんって思うこと多い+4

-0

-

21. 匿名 2025/10/16(木) 12:48:43

こういうのって氷山の一角だよね。+9

-1

-

22. 匿名 2025/10/16(木) 12:48:51

ガルにもAI貼る人がなんなん?+15

-0

-

23. 匿名 2025/10/16(木) 12:49:02

>>11

30年前のアイコラはネットで拡散できなかったからなぁ

その代わり今の時代だとみんなAI疑うから信用されないって利点もある+5

-0

-

24. 匿名 2025/10/16(木) 12:49:52

>>20

といってもAIの進化は累乗だから、もうすぐ見分けつかなくなるよ+6

-0

-

25. 匿名 2025/10/16(木) 12:51:02

ミクが開発された時もわいせつな言葉を云わせたやらあったみたいだし

ある種想定はされただろうが、あくまで個人で楽しむ範囲でならねぇ

という感じはあるが、それをお金儲けの道具にしてはダメだわ。+6

-0

-

26. 匿名 2025/10/16(木) 12:51:40

>>1

こんなニュースばかりではないんだろうけど免許制とかになる時代がくるのかねぇ

誰でも悪用しようと思えば簡単にできるってのは怖い+4

-1

-

27. 匿名 2025/10/16(木) 12:51:47

>>7

女👩でもやっています、金とAl 加工職人の趣味で😆+4

-0

-

28. 匿名 2025/10/16(木) 12:52:06

>>7

なるよ

レンタルビデオ屋に勤めていた時

どんな名作より貸し出しベスト10は全てAV+5

-1

-

29. 匿名 2025/10/16(木) 12:52:07

>>16

自分1人で見てるだけならセーフなんじゃない?知らんけど+1

-1

-

30. 匿名 2025/10/16(木) 12:52:17

ズリネタは青天井やな+1

-1

-

31. 匿名 2025/10/16(木) 12:52:25

これ捕まったのがたまたま日本人だけど、海外サーバーじゃ無法地帯だよ+9

-1

-

32. 匿名 2025/10/16(木) 12:53:26

日本にビデオデッキが普及したのも

家庭でAVのカセットビデオ見たさにだったしね+6

-2

-

33. 匿名 2025/10/16(木) 12:54:11

>>31

〇〇(名前)deepfake検索で出るわ出るわ。警察は海外勢力にはとことん無能なのがわかる。+9

-1

-

34. 匿名 2025/10/16(木) 12:54:16

>>28

流石に人気ベスト10! ってAVは並べられないいので

勤めている人だけが知っている情報を知ってしまったって感じ。+4

-1

-

35. 匿名 2025/10/16(木) 12:54:58

>>14

アメリカではsnsの顔画像を勝手に合成されて

ばら撒かれた事件があったらしいよ

+9

-0

-

36. 匿名 2025/10/16(木) 12:58:36

アイコラ(死語)でアウトだからそりゃねぇ+5

-0

-

37. 匿名 2025/10/16(木) 13:00:41

>>7

女でも推しと自分で作っている人XやTikTokで見るけど+4

-0

-

38. 匿名 2025/10/16(木) 13:01:09

>>34

ボクも彼氏の紹介でAV撮ったことあるよお礼に

200万とホンダの高級軽自動車貰った❤️![芸能人らに酷似のわいせつ画像、生成AIで作成しSNSに掲載疑いで逮捕…120万円得たか]()

+0

-7

-

39. 匿名 2025/10/16(木) 13:02:26

>>8

ムサいおっさんが画像処理で美少女に早変わりして声も変えられる時代だし、生成AIを使いこなせたら、類似犯罪が増えそうよね+8

-1

-

40. 匿名 2025/10/16(木) 13:03:32

>>3

この前、動物のほのぼの系ショート動画が表示されて見てたんだけど、コメ欄でその動画が生成AIってこと知って激しい嫌悪感持った。なんか気持ち悪いんだよね、まがいもの作ってまで注目集める感じが。+26

-1

-

41. 匿名 2025/10/16(木) 13:04:47

エロ系はダメだってさっさと規制したらいいのに。+13

-1

-

42. 匿名 2025/10/16(木) 13:13:28

>>1

アマゾンでも女性芸能人とビキニを合成させたポスターを売ってるけどあれはどうなんだろう+7

-1

-

43. 匿名 2025/10/16(木) 13:18:38

>>17

そういう事してると夢と現実の区別が付かなくなって推しが結婚したら怒るのだろうか+2

-1

-

44. 匿名 2025/10/16(木) 13:20:33

Amazonで売ってるAIエロ写真集も逮捕してほしい+6

-0

-

45. 匿名 2025/10/16(木) 13:23:42

>>3

soraってやつがリアル

赤ちゃんと動物のとか

TikTokだとみんな騙されてる+17

-0

-

46. 匿名 2025/10/16(木) 13:25:11

>>14

Iphoneのロック 顔認証用にAI生成して解除されるのに

顔出しするのは+1

-0

-

47. 匿名 2025/10/16(木) 13:29:02

+0

-1

-

48. 匿名 2025/10/16(木) 13:31:39

>>31

外国人に稼ぎ方教えたようなもんだよね。+2

-1

-

49. 匿名 2025/10/16(木) 13:31:47

>>2

絶対にAI使ってこういう類の犯罪は出ると思ってたよ+7

-0

-

50. 匿名 2025/10/16(木) 13:32:23

この先本物か偽物かの境界線が曖昧になりそう

AI恐ろしい+5

-0

-

51. 匿名 2025/10/16(木) 13:41:52

アダルト以外でも「これAIかな?」と疑わしいものがある

ダイエットサプリの広告で「倖田來未監修」って書かれてて、本人が喋ってる映像が流れるけど本当に関わってるのかな?と+3

-0

-

52. 匿名 2025/10/16(木) 13:42:50

>>2

昔からアイコラとかあったけどね。アイコラは首とかすげ替えてるのバレバレだったけどAI使われると区別つかないもんな…

アイコラの時点でそんなもん配布してる奴捕まえろよと思ってたけど+6

-0

-

53. 匿名 2025/10/16(木) 13:46:49

>>13

昨日アダルト系解禁されるってニュース見たよ

これだけ問題になってるのになぜわざわざ解禁するんだか+6

-0

-

54. 匿名 2025/10/16(木) 13:53:44

>>4

人気芸能人はアングラサイトに顔のデータがあるらしいよ+0

-0

-

55. 匿名 2025/10/16(木) 13:54:41

>>51

最近多いね+0

-0

-

56. 匿名 2025/10/16(木) 14:21:22

>>7

個人で写真一枚あればできちゃうってほんと?夫が職場の女性の写真で合成作ってたのを見つけた相談とか聞いたことあるけど、怖くない?+1

-1

-

57. 匿名 2025/10/16(木) 15:01:19

>>34

広告代理店時代はテレクラやテレフォンサービス全盛期で

AVチャンネル

桜樹ルイだけ桁が違って

ぶっちぎりの一位だった

+0

-0

-

58. 匿名 2025/10/16(木) 15:01:54

>>45

今日まさに騙されたひとりだよ…全然気づかなかった。

コンビニに入ってきた猫を警察官が抱っこして追い出す、みたいな内容でさ、もうショック。+6

-0

-

59. 匿名 2025/10/16(木) 15:26:38

>>37

え?絡みの画像を?!+0

-0

-

60. 匿名 2025/10/16(木) 15:35:05

>>17

五千歩譲って自分だけで楽しめばまだいいのに、なぜSNSにあげるのか?+4

-0

-

61. 匿名 2025/10/16(木) 15:35:15

>>56

キスとかハグは写真一枚でできるね

エロは規制あるから見たことないけど知識があれば作れるだろうな+0

-0

-

62. 匿名 2025/10/16(木) 15:41:29

>>17

アイドルとアイドルが同性同士でキスしてるのもあった+1

-0

-

63. 匿名 2025/10/16(木) 15:46:42

>>3

精度が高くなってきてる

それにフェイクニュースも巧妙になってるから、本当に嘘を嘘と見抜けないとネットを使えない時代が来てるわ+3

-0

-

64. 匿名 2025/10/16(木) 16:56:29

最近AIの普及速度がちょっと怖いレベルなんだけど。

youtubeでも特に動物ハプニング系の動画はAI動画が増産されてて、

もう収拾つかないレベルになって来てると思う。

あんな動画ばかりになったら誰もyoutube見なくなるんじゃないかな+2

-0

-

65. 匿名 2025/10/16(木) 17:41:12

罪のない画像を生成したいだけなのにうまくできない

そんなリアルな画像どうやって作れるのか教えてほしいわ

+2

-0

-

66. 匿名 2025/10/16(木) 19:26:51

>>7

何か新しいものができるとエロに直結できるかだからね男は+2

-1

-

67. 匿名 2025/10/16(木) 19:27:04

>>38

コレはAI⁉️+0

-0

-

68. 匿名 2025/10/16(木) 19:32:52

>>56

今普通に問題になってるよ

会社のHP、学校アカで顔出ししてる高校生、それ大丈夫?っての多い+1

-0

-

69. 匿名 2025/10/16(木) 19:46:54

なんか今次から次へと

自分と好きな芸能人のツーショット写真とか

作られているよね

うっかり目にはいるんだけど気分悪い+4

-0

-

70. 匿名 2025/10/18(土) 04:57:03

>>42

その芸能人の事務所に通報でしょ+1

-0

コメントを投稿する

トピック投稿後31日を過ぎると、コメント投稿ができなくなります。削除すべき不適切なコメントとして通報しますか?

いいえ

通報する

画像生成AI(人工知能)で女性芸能人らに似せて作ったわいせつ画像をSNSに掲載したとして、警視庁は16日、秋田市の会社員の男(31)をわいせつ電磁的記録記録媒体陳列容疑で逮捕したと発表した。昨年10月以降、女優やアイドル、アナウンサー計262人に酷似したAI作成の性的画像約2万点をSNSに掲載し、計約120万円の閲覧料を得たとみている。