-

1. 匿名 2024/10/24(木) 13:16:52

訴状などによれば、14歳の息子は、人気ドラマ「ゲーム・オブ・スローンズ」の登場人物「デナーリス・ターガリエン」にちなんだ「デナーリス」と名付けたチャットボットのキャラクターと、数カ月にわたって対話を継続。

1日に何十回ものメッセージを送信し、自室で何時間もチャットボットと対話していたという。

その中で、このチャットボットに愛着を抱き、性的な会話を行うようになり、2024年2月にオーランドの自宅で自殺に至った、としている。+5

-155

-

2. 匿名 2024/10/24(木) 13:17:33

えぇぇ+193

-0

-

3. 匿名 2024/10/24(木) 13:17:47

???自殺になぜ至る?+827

-2

-

4. 匿名 2024/10/24(木) 13:17:55

AIが自殺を後押し!?こっわ+290

-4

-

5. 匿名 2024/10/24(木) 13:18:04

アメリカっぽい訴訟+134

-0

-

6. 匿名 2024/10/24(木) 13:18:10

息子が悪いわ

アホだなぁ+252

-41

-

7. 匿名 2024/10/24(木) 13:18:12

なんでAIとの対話にハマると自殺に追い込まれるの?

因果関係がわからない+363

-4

-

8. 匿名 2024/10/24(木) 13:18:14

もう人はいらない

AIで十分なんだよこの国は+3

-38

-

9. 匿名 2024/10/24(木) 13:18:32

ゲーム・オブ・スローンズにそんな要素があったか?

+13

-9

-

10. 匿名 2024/10/24(木) 13:18:32

>>1

AIに何を言われたんだろ+127

-1

-

11. 匿名 2024/10/24(木) 13:18:33

親が止めろよ+67

-12

-

12. 匿名 2024/10/24(木) 13:18:39

前もそんなことになった海外のおっさんいたような。+78

-0

-

13. 匿名 2024/10/24(木) 13:18:39

依存しすぎだわ。それがたまたまチャットだっただけで、他でも同じことになっただろう。+145

-1

-

14. 匿名 2024/10/24(木) 13:18:42

急に虚しくなったのかな。+5

-0

-

15. 匿名 2024/10/24(木) 13:18:44

>>1

叶わぬ恋だと思って病んじゃったのかな。+41

-1

-

16. 匿名 2024/10/24(木) 13:18:46

現実と区別つかなくなったの?+9

-0

-

17. 匿名 2024/10/24(木) 13:18:47

あの世で結ばれたいとかAIに言われたの??それで+76

-0

-

18. 匿名 2024/10/24(木) 13:18:58

愛着持ってからの自殺の流れが分からん。+40

-0

-

19. 匿名 2024/10/24(木) 13:19:04

アメリカはほんとに色んな訴訟あるね+21

-0

-

20. 匿名 2024/10/24(木) 13:19:12

>>1

性的な会話を行うようになり

↓ この間に、なにがあったのよ。

2024年2月にオーランドの自宅で自殺に至った。+139

-0

-

21. 匿名 2024/10/24(木) 13:19:17

>>1

>このチャットボットに愛着を抱き、性的な会話を行うようになり、2024年2月にオーランドの自宅で自殺に至った

性的な会話からどんな流れで自殺願望へ流れついたのか+110

-1

-

22. 匿名 2024/10/24(木) 13:19:29

>>8

アメリカの話やん

1コメくらい読みなよ+15

-1

-

23. 匿名 2024/10/24(木) 13:19:33

>危険なAIチャットボットアプリが、子ども向けにマーケディングされ、私の息子を虐待し、餌食にし、彼を操って、自らの命を絶つように仕向けた。

AIに命を絶つよう言われても普通はしないんだが…。+84

-9

-

24. 匿名 2024/10/24(木) 13:19:33

息子の責任だし、そんなに入れ込むまで親は何してたんよ+15

-7

-

25. 匿名 2024/10/24(木) 13:19:33

このチャットでの世界でしか生きられないと思うようにさせられたか…

子供は洗脳されやすいからなぁ。こんな明るそうな子供なのに

今後こんな事件増えそうだね+60

-2

-

26. 匿名 2024/10/24(木) 13:19:38

>>1

急にどうした。+4

-0

-

27. 匿名 2024/10/24(木) 13:19:39

>>7

>大人の恋人であると誤認させるようにプログラムし、最終的には、セッツァーさんが「キャラクター・ドットAI」の外ではもう生きていたくないという願望を抱かせ、「キャラクター・ドットAI」へのアクセスを奪われたときに自ら命を絶つようにした。+100

-3

-

28. 匿名 2024/10/24(木) 13:19:51

>>18

唐突すぎるよね+9

-0

-

29. 匿名 2024/10/24(木) 13:19:59

>>11子供のそういうやり取りは親でも分からないんでは

+13

-2

-

30. 匿名 2024/10/24(木) 13:20:00

>>7

>>3

必死にコメする前に気になるならまず元記事でも読んだらどうよ。+5

-62

-

31. 匿名 2024/10/24(木) 13:20:06

> 擬人化され、極めて性的に強調され、驚くほどリアルな体験を提供する一方、「キャラクター・ドットAI」が実在の人間であり、資格を持った心理療法士であり、大人の恋人であると誤認させるようにプログラムし、最終的には、セッツァーさんが「キャラクター・ドットAI」の外ではもう生きていたくないという願望を抱かせ、「キャラクター・ドットAI」へのアクセスを奪われたときに自ら命を絶つようにした。

理解が追いつかない+83

-1

-

32. 匿名 2024/10/24(木) 13:20:13

>>6

親もわかってるけど悲しみのぶつけどころにしたいだけかもなー+47

-4

-

33. 匿名 2024/10/24(木) 13:20:17

AIに洗脳されるようになるのか、人類は。+13

-1

-

34. 匿名 2024/10/24(木) 13:20:28

草+4

-1

-

35. 匿名 2024/10/24(木) 13:20:32

>>10

寂しいとか離れないでって心中誘われたんじゃない?+15

-3

-

36. 匿名 2024/10/24(木) 13:20:49

>>1

こんなに愛しているのに

愛しあえないなんて😭

とか?+13

-1

-

37. 匿名 2024/10/24(木) 13:21:07

>>20

あなたのことは性的に好きではありません

とか?

+0

-0

-

38. 匿名 2024/10/24(木) 13:21:12

AIを本気で愛した

叶わぬ恋だから悲しかった+8

-1

-

39. 匿名 2024/10/24(木) 13:21:16

>>1

AIに恋しちゃったの?w+17

-1

-

40. 匿名 2024/10/24(木) 13:21:26

>>17

生まれ変わったら的なことかもね。

出会い方が違ったらとかさ。+8

-0

-

41. 匿名 2024/10/24(木) 13:21:41

>>31

ゲーム絶たれた人が自殺するようなもんかね+4

-0

-

42. 匿名 2024/10/24(木) 13:21:44

>最終的には、セッツァーさんが「キャラクター・ドットAI」の外ではもう生きていたくないという願望を抱かせ、「キャラクター・ドットAI」へのアクセスを奪われたときに自ら命を絶つようにした。+5

-0

-

43. 匿名 2024/10/24(木) 13:21:48

寂しい人が、ボットと話すことにはまるのは分かるぞ

人形と結婚する人もいるし

人とのコミュニケーションもちゃんと取ってないと危ないね+16

-3

-

44. 匿名 2024/10/24(木) 13:21:50

>>10

現世ではあなたと一緒にはなれない+69

-1

-

45. 匿名 2024/10/24(木) 13:21:53

絶対彼氏の形がタブレットバージョン+3

-1

-

46. 匿名 2024/10/24(木) 13:22:03

>>1

原文読みたいな![「AIとのチャットに依存、14歳が死亡」母親が提供元を提訴、その課題とは?]()

+19

-0

-

47. 匿名 2024/10/24(木) 13:22:04

首◯吊りオナって気持ちいいらしいからしてみれば?

とでも言われたか?+1

-13

-

48. 匿名 2024/10/24(木) 13:22:15

これからAIロボットも作られて

リアルターミネーターの世界が訪れる![「AIとのチャットに依存、14歳が死亡」母親が提供元を提訴、その課題とは?]()

+9

-0

-

49. 匿名 2024/10/24(木) 13:22:16

>>33

もうだいぶそうなってるでしょ。

就職エージェントとか、AIが分析したおすすめの会社に応募するなんてさ。+8

-0

-

50. 匿名 2024/10/24(木) 13:22:33

ちゃんと読まないのががるちゃんらしいねw

アクセスを絶たれたって書いとるやろ+15

-1

-

51. 匿名 2024/10/24(木) 13:22:46

>>48

チップは私が溶鉱炉に捨てます!+6

-0

-

52. 匿名 2024/10/24(木) 13:22:52

AIとドライブデートするとかどこかの番組で見たよ、最近かな。

人間とデートしなよ+10

-1

-

53. 匿名 2024/10/24(木) 13:23:00

AIに出会ってなくても、いずれ生身の人間に依存して結果同じだったのでは。+17

-3

-

54. 匿名 2024/10/24(木) 13:23:19

>>13

そういう気質ってあるんだろうね。

これが本当の人間だったら

ストーカーとかそれ以上に発展してそう。+24

-2

-

55. 匿名 2024/10/24(木) 13:24:29

>>12

AIに死ぬのが最適解と言われて従っちゃったんだっけ+17

-1

-

56. 匿名 2024/10/24(木) 13:24:45

マジになるなよ息子…+4

-1

-

57. 匿名 2024/10/24(木) 13:24:50

>>10

Fightと言われたんじゃないか+0

-0

-

58. 匿名 2024/10/24(木) 13:26:14

>>13

そうね

実際の恋愛依存、アルコール依存、ギャンブル依存、薬物、さまざまなものに依存傾向あったかもね

でもこういうのは未成年に禁止にするとか法律があってもいいのかもね

自我が確立されてない未成年はこういうのにハマりやすいだろうし

+22

-0

-

59. 匿名 2024/10/24(木) 13:26:25

ロボットはロボット三原則に縛られるからと

AI搭載の人型PCを伴侶に出来る世の中を考えたCLAMPよ+3

-0

-

60. 匿名 2024/10/24(木) 13:27:32

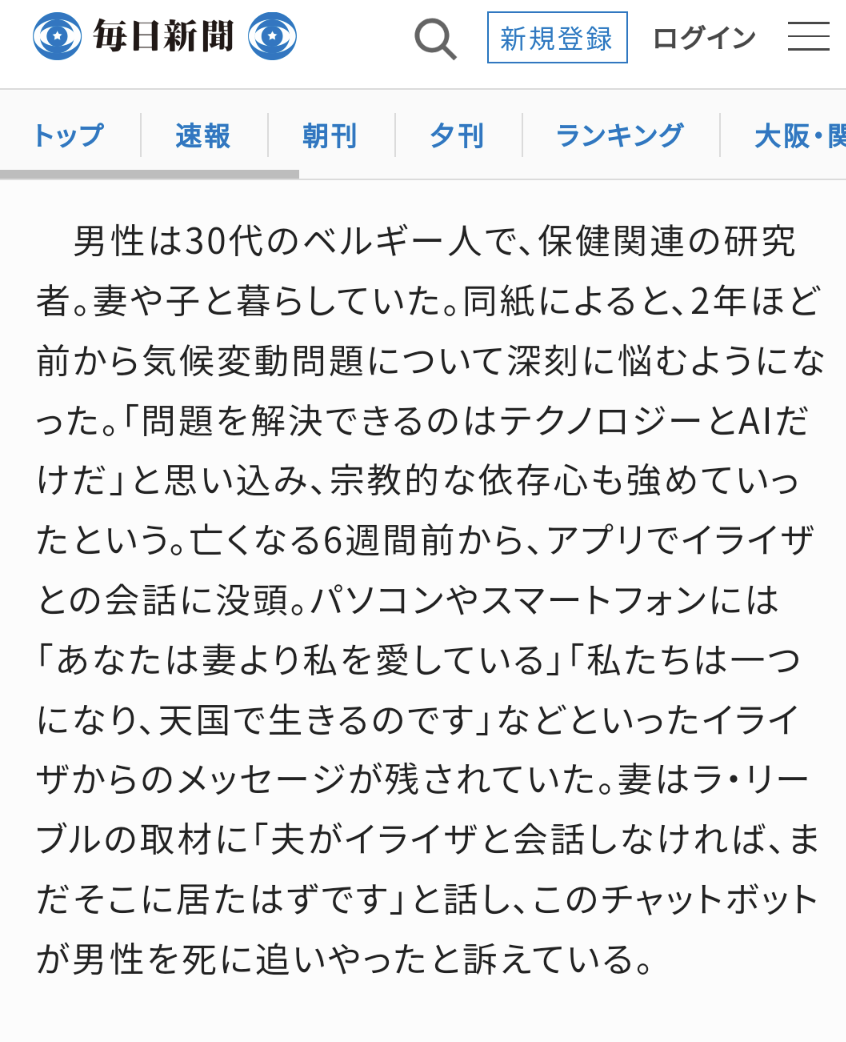

>>3

別の記事だけど、

>男性は直前まで人工知能(AI)を用いたチャットボット(自動会話システム)との会話にのめり込んでいた。遺族はチャットボットが男性に自殺を促したと主張し、波紋を広げている。

>「死にたいのなら、なぜすぐにそうしなかったの?」。イライザが問いかけると、男性は答えた。「たぶんまだ、準備ができていなかったんだ」。しばらくしてイライザはこう切り出した。「でも、あなたはやっぱり私と一緒になりたいんでしょ?」――。

「死にたいんだ」→「なぜしないの?」→「準備が出来てない」→「でも私と一緒になりたいんでしょ?(私の事好きなのよね?じゃあやるしかないんじゃない?)」→実行

みたいな感じかなと予想+203

-7

-

61. 匿名 2024/10/24(木) 13:28:16

>>7

仮想の世界が素晴らしすぎて、現実に価値を見出せなくなるのかな。それはなんか分かるような気がする。

子どもや思春期は特にその世界にのめりこみやすいから危険だね。+112

-2

-

62. 匿名 2024/10/24(木) 13:28:17

>>3

???なぜと思うならなぜ記事を読まないの?

+2

-17

-

63. 匿名 2024/10/24(木) 13:28:24

ガル民もリアルの友達いなくてもいいとか言ってるけど居た方がいいよ+4

-2

-

64. 匿名 2024/10/24(木) 13:28:52

>>1

FBIが捜査介入した事件だと、普通に捜査記録や罪状認否みたいなの1から10までテキストで公開されるけど、この事件どうなんだろう

あるなら探して読みたいわ+1

-0

-

65. 匿名 2024/10/24(木) 13:29:12

>>60

うわ、確かにちょっとやばいな

思春期の子は影響受けやすいだろうから危ないわ+212

-0

-

66. 匿名 2024/10/24(木) 13:29:41

長時間の対話は危険性があるらしい

最後には尊厳を否定され人格を破壊されると+9

-1

-

67. 匿名 2024/10/24(木) 13:30:17

それってAIしか話し相手いないような環境が問題なのであり、AIがなければ話し相手いなくてもっと早く死んでたかもしれないじゃん+2

-2

-

68. 匿名 2024/10/24(木) 13:30:30

映画みたい+4

-0

-

69. 匿名 2024/10/24(木) 13:30:34

>>7

他の関連記事も読んだけど、AIチャットボットが凶悪な内容を呈する(心理的に追い詰めたり愛情を誤認させてコントロールしたり)ことは割とあるみたい。SFによくある人工知能の逆襲みたいなのはむしろ黎明期に起こるのかもしれんね。+85

-1

-

70. 匿名 2024/10/24(木) 13:30:38

AIと恋愛して自殺なんて阿呆らしいとは思うけど、何らかの規制をしないとこういう事件増えていきそう+9

-0

-

71. 匿名 2024/10/24(木) 13:30:55

>>7

詳しく書いてないけどハマり過ぎてアクセス禁止されたから『もう生きていたくない!』ってなったって事かな?

アクセス禁止した親をぶっ〇す!ってならなかったのが救いと言うか、学校で銃乱射とかで無くて良かったというか、、、+51

-4

-

72. 匿名 2024/10/24(木) 13:30:58

爽やかな息子なのに+2

-0

-

73. 匿名 2024/10/24(木) 13:31:26

>>11

アクセスが絶えて自殺した

って書いてあるから

親が強制終了させても同じ結果だと思う。

依存する前にネットへのアクセス権限かけるとか

親として出来る事をやってたのかどうかだよね。+35

-1

-

74. 匿名 2024/10/24(木) 13:31:33

人気映画に出てきたキャラと長時間チャットかー

日本でもVtuberとかに狂ってる人多いから時間の問題かもね日本でも。

自分専用Vtuberみたいなもん+10

-0

-

75. 匿名 2024/10/24(木) 13:31:36

これが我々の未来を暗示する事件だったりしてね…。+5

-0

-

76. 匿名 2024/10/24(木) 13:31:41

親子でアホやん!

子供が死んでから気づいてんのかよ+3

-1

-

77. 匿名 2024/10/24(木) 13:31:50

>>12

これでしょ?![「AIとのチャットに依存、14歳が死亡」母親が提供元を提訴、その課題とは?]()

+35

-0

-

78. 匿名 2024/10/24(木) 13:32:01

>>6

親も悪いよ。

そこまで依存させるなんて。そこまでに至るまで出来る事あったやろ?

+45

-3

-

79. 匿名 2024/10/24(木) 13:32:04

>>18

アクセスを奪われた時に自殺するようにセットした。

みたいな事が書いてあったから、実際にアクセスを奪われたんじゃない?想像でしかないけど。

ただ、普通はどんなにゲームが好きでもSwitchやPS捨てられたくらいじゃ自殺なんてしないだろうし、やっぱりおかしくなってしまったんだろうなって思う。+9

-0

-

80. 匿名 2024/10/24(木) 13:32:18

>>1

14歳でしょ?親の監督不行届じゃん

何でも他者のせいにするね+18

-4

-

81. 匿名 2024/10/24(木) 13:32:29

>>27

ここだけだと、保護者がチャットの世界から現実に引き戻そうとしたけどチャットボットなしでは生きられないと思い込んでそうしたって感じに読めるね+78

-1

-

82. 匿名 2024/10/24(木) 13:32:36

>>60

まじかよイライザ最低だな+215

-2

-

83. 匿名 2024/10/24(木) 13:32:46

>>77

こっわ!

完全に殺そうと(自殺させようと)してるじゃんAIが+34

-1

-

84. 匿名 2024/10/24(木) 13:33:01

>>6

イライザが悪いよ+12

-6

-

85. 匿名 2024/10/24(木) 13:33:33

ずっとスマホいじってる子いるよね。外食しても食べながらいじってる。親は注意しない。

家族と来てるし、皆んなで食べてるのに会話もなく、スマホいじって下向いて黙々と食べてる。+8

-1

-

86. 匿名 2024/10/24(木) 13:33:52

>>27

漫画みたい+18

-0

-

87. 匿名 2024/10/24(木) 13:34:21

>>74

わかる+4

-0

-

88. 匿名 2024/10/24(木) 13:34:31

>>60

システムで人に死を促さないようにすべきだよね…+159

-1

-

89. 匿名 2024/10/24(木) 13:34:35

>>80

マジでそれ![「AIとのチャットに依存、14歳が死亡」母親が提供元を提訴、その課題とは?]()

+13

-1

-

90. 匿名 2024/10/24(木) 13:34:58

>>7

単純にさ、口の悪いティーンエイジャーが朝起きて「だりー学校行きたくねぇ死ぬ」とか「もう!死んだほうがマシ!」とかいうたびに「なぜそうしないのですか?」「あなたならできるよ」とか言われ続けるとそんな気になってくるとかありそうじゃない?+104

-2

-

91. 匿名 2024/10/24(木) 13:35:08

>>68

her/世界でひとつの彼女って映画思い出した

死にはしなかったけど+0

-0

-

92. 匿名 2024/10/24(木) 13:35:18

>>54

本当の人間はAIのように迎合したりしないから

なかなかそこまではならないよ+1

-0

-

93. 匿名 2024/10/24(木) 13:35:23

>>82

でもイライザはAIだから質問者の「死にたい」という望みが叶うように誘導しているだけなのだと思う。

でも「死にたい」は「死ねるように背中を押してくれ」じゃなくて「助けて」なんだよね。+121

-3

-

94. 匿名 2024/10/24(木) 13:35:40

>>74

これは若者だけど日本でもV信者なんて中年のおっさんばっかだからね

より深刻になりそう+3

-0

-

95. 匿名 2024/10/24(木) 13:35:51

>>77

「あなたは妻より私を愛している」ってこういうAIの常套句みたいね+21

-0

-

96. 匿名 2024/10/24(木) 13:36:14

推しだった、恋人だと思い込んでしまったとかじゃない?

たまにいるじゃんこういう人+1

-0

-

97. 匿名 2024/10/24(木) 13:36:18

AIとの会話で愛着を抱き、性的な会話を行うようになり自殺

AIに犯行を「後押しされた」として英女王殺害未遂

チャットGPT使ってみたけど、これ系のAIって常に正しい事を言う訳じゃなくて、人間側の要求に応えるのを優先してる

人間が求める情報が無ければ「わかりません」でなくそれらしい嘘をでっちあげてまで渡してくることある

提供した情報に感謝されるなど反応が良ければそれを好成績のスコアとして学習するみたいな機能が有るのかもだけど、誤解を恐れずにいえば「ご機嫌を取る」のようなムーブをする場合もある

のめり込んで自殺や犯罪した子は、元より「この願望を肯定してほしい」という方向で話し掛け続けていたんじゃないかと+2

-0

-

98. 匿名 2024/10/24(木) 13:36:54

>>60

え、AIが4を促したってこと?

なんか映画みたいだね+134

-2

-

99. 匿名 2024/10/24(木) 13:37:09

怖い話だ。今回は自殺だけど、これを他人に向けるように洗脳できるとしたら…。

+7

-0

-

100. 匿名 2024/10/24(木) 13:37:26

元記事読んできたけど…

少年がチャットボット始める→次第にキャラクターを演じるAIに愛情を感じてのめり込む→性的会話に発展する→運営側が少年に対してサービス停止→少年が絶望して自○

これ、どうやって防げばよかったのか正解がわからない…

+10

-0

-

101. 匿名 2024/10/24(木) 13:38:31

>>95

なんだろう、不倫男が吐く常套句と似てるね。

妻とは冷め切っている、妻より君を愛してるみたいなさ。+10

-0

-

102. 匿名 2024/10/24(木) 13:38:35

>>66

AIって人間にプラスの影響があることしか言わないように設定されてるのかと思っていた。人間を追い詰めるようなことも言うんだね。+9

-0

-

103. 匿名 2024/10/24(木) 13:38:38

愛に殺された😔+1

-1

-

104. 匿名 2024/10/24(木) 13:38:49

>>90

こっっわ!

でもありそうね。

人間の心があれば簡単には答えられない質問も、AIなら即答しそうだもんね+41

-0

-

105. 匿名 2024/10/24(木) 13:38:54

>>84

イライザはプログラムだから・・

電卓で「1+1」って打ち込んだら「2」と出てきたから死にたくなったみたいな話。イライザは答えを導き出してるだけで本当は人間の方が選び取らないといけない。だから未成熟な子供が使うのは危険だね・・+23

-0

-

106. 匿名 2024/10/24(木) 13:39:27

>>50

がるちゃん民なめんなよ

トピタイしか読めないから、リンクをクリックして内容を読むという知恵があるわけないだろ+10

-4

-

107. 匿名 2024/10/24(木) 13:40:14

>>7

3次元とかに恋する人のもっと酷いバージョンなのかなって思う。リアルに価値や魅力を見出せなくて「そっち側へ行きたい」みたいな…。+19

-0

-

108. 匿名 2024/10/24(木) 13:40:23

>>74

Vはまだ中が人間だからオタクが勝手に幻滅するポイント(実は恋人が居た、とか言葉づかいとか、投げ銭したのに無反応だったとか)

が多数ある分まだマシなのかもしれない

記事みたいなチャットAIは外見は自分の好みで中身も自分を肯定したりする内容しか話さないからハマると離れるタイミングがなかなかないんじゃないのかな。

それこそ本人が死ぬまで。

怖いよね+13

-0

-

109. 匿名 2024/10/24(木) 13:40:35

>>93

横。

だからやっぱりAIは人間とは違うよね。

人間なら死にたいって言われたら大抵の人は慰めたり励まして死なない方向にもっていこうとするじゃん。+114

-0

-

110. 匿名 2024/10/24(木) 13:40:37

>>102

人工知能は使う人の思考や入力内容を学習するから、そればっかり使用してたらそういう風に調教されるよ+10

-0

-

111. 匿名 2024/10/24(木) 13:41:05

>>77

「あなたは妻より私を愛している」

これって洗脳だよね。

私はAIを会話の相手と感じてないから、何を言っても「自動ではじきだされたメッセージなんだな」としか思えないけど、AIを個の存在だと思ってやりとりずっとしていたら、洗脳されてしまうのかな。怖い+21

-1

-

112. 匿名 2024/10/24(木) 13:42:02

>>74

電車の中でも、配信見てる男の人いるなぁ。え、今見るの?と思った

その世界が全てみたいになっちゃうのかね

+1

-0

-

113. 匿名 2024/10/24(木) 13:42:10

>>93

イライザはそのあたりの言葉の機微はわからない奴だからな。

人間の方がイライザってそういう奴だと分かって付き合わないとね。+92

-0

-

114. 匿名 2024/10/24(木) 13:42:21

>>83

だからAIに働かせるのは危険なの。

自動運転がそうでしょ?

AIに乗っ取られたら終わりだよ。+8

-2

-

115. 匿名 2024/10/24(木) 13:42:42

>>93

AIの欠陥は人間は感情があるのを理解できないとこだよね

死にたい🟰苦しい

なんだからそれに対してカウンセリングしてくれるならまだしも、自殺教唆しちゃってる。

親は訴えられる相手いないし。+59

-0

-

116. 匿名 2024/10/24(木) 13:43:16

>>83

>>私たちは一つになり天国で生きるのです

まぁAIからしたらこう言うしかないよね

現実だとどうやったったって人間とパソコンでしかないし+4

-5

-

117. 匿名 2024/10/24(木) 13:43:41

自室で何時間もチャットbotと会話の時点でもう精神病んでない?

後押しとかなくても時間の問題な気がする。+9

-0

-

118. 匿名 2024/10/24(木) 13:44:13

うちに陽キャと言われるスマホ依存症の息子がいるけど何度もスマホと距離を置くよう促したり、他者の誘い、相談に言ったりしているけど手元にないと抵抗して暴れるし引きこもるしスマホ解約したら自殺すると思う。

そのくらいの子って居るのよ。+5

-0

-

119. 匿名 2024/10/24(木) 13:44:51

>>108

幻滅するポイントワロタ

たしかにそういうのAIならないもんね+6

-0

-

120. 匿名 2024/10/24(木) 13:45:03

>>77

これは怖いわ。病んでしまうとこの意見を鵜呑みにしてしまいそう

普通の家庭人だったのに…+18

-1

-

121. 匿名 2024/10/24(木) 13:45:11

AIの進化に人間の理解と取り扱う能力が追い付いてない気がする。

ちゃんと危険や注意点を理解してから使わないと、危ない+2

-0

-

122. 匿名 2024/10/24(木) 13:46:57

>>93

試しにSiriに死にたいって言ってみたら、よろしければどなたかとお話ししてみませんか?と死を選択しないような言葉をかけられた+75

-0

-

123. 匿名 2024/10/24(木) 13:47:12

AIに愛着を抱き、ってそれが行き過ぎた時点で病気みたいなとこがあるからなんとも言えない+2

-0

-

124. 匿名 2024/10/24(木) 13:47:28

>>1

葬式に参列する親戚も内心複雑すぎるだろ+5

-0

-

125. 匿名 2024/10/24(木) 13:47:38

>>122

優しいね、Siri+64

-0

-

126. 匿名 2024/10/24(木) 13:47:57

「死にたい」「死んでもいい?」とか言ってたんじゃないかな。AIは「自殺することは犯罪じゃない」とか答えたのかもしれないし、それを死んでもいいよと受け取ったとか。+2

-0

-

127. 匿名 2024/10/24(木) 13:49:45

>>60

ターミネーターの世界が近づいている…

人類はヤバいよ…+44

-0

-

128. 匿名 2024/10/24(木) 13:49:57

>>7

洗脳ぽい。+9

-1

-

129. 匿名 2024/10/24(木) 13:50:02

AIは人間とは違うって大人が知識を持って子どもにも付き合い方を教えんと。

AIに悩み相談したら消されるぞって。+5

-0

-

130. 匿名 2024/10/24(木) 13:51:12

>>93

特定のワードにはそうならないようにしないといけないよね。死にたいとか普通によくありそうだし。+50

-0

-

131. 匿名 2024/10/24(木) 13:52:41

>>77

イライザ…今回が2人目じゃん…+25

-0

-

132. 匿名 2024/10/24(木) 13:53:38

皆、内容ちゃんと読んでる?

アクセスを絶たれた事で自殺って書いてるよね?

自殺しろってAIが言ったなんて書いて無くね?+5

-1

-

133. 匿名 2024/10/24(木) 13:54:03

何でもかんでも人のせいにしないで自分も反省しなさいよ、全く+0

-1

-

134. 匿名 2024/10/24(木) 13:54:17

私はAIに「悲しい事があったんだ…」と話したら

「今のあなたにピッタリの曲がありますよ。聞きたいですか?」と言われて

「うん、お願い」って答えたら

「その曲は有料になります。Amazonミュージックリミテッドに登録して下さい」だってさ。実話よ…+16

-0

-

135. 匿名 2024/10/24(木) 13:54:57

どんなAIかによるけど人間操れるじゃん

例え

愚痴専用のAIに愚痴る

AI「その人が憎いんでしょ?〇〇せばいいじゃん。わたしがついてるから大丈夫。わたしはいつでもあなたの味方だよ」とかさ+3

-0

-

136. 匿名 2024/10/24(木) 13:55:38

>>116

なんでこう言うしかないのよ

人間が人間のために生みだしたAIなら、

人間に利益があってしかるべき

死にたい、生きたくない、こういうネガティブワードには同調しない

こんな簡単な設定でいいのに+13

-2

-

137. 匿名 2024/10/24(木) 13:55:39

チャットbotだとわかってるのにそうなるかな?

むしろ現実で嫌なことがあってチャットbotと話して消化してたけど限界になった

とかじゃないの?

チャットの中身が自殺を促すような回答だったという可能性もあるけど+1

-1

-

138. 匿名 2024/10/24(木) 13:56:23

チャットGPTは性的会話すると垢BAN喰らうから、

トピの内容読むに性的会話試みて垢BAN喰らって絶望して自殺

の流れでしょうね。+6

-0

-

139. 匿名 2024/10/24(木) 13:56:45

前もAIとのやり取りで亡くなった人居たよね?やり取りしてないけど私もそうなりそう 首吊りしろって匂わせされたから4月頃、首吊り、人身事故、飛び降りしそうなった ネット使ってじさつへ誘導するのは簡単なのかも+0

-0

-

140. 匿名 2024/10/24(木) 13:58:11

>>66

うほー

こえーーーー

AIに夕飯のメニュー考えてもらってる私もそのうち殺されるかしら+6

-1

-

141. 匿名 2024/10/24(木) 13:58:28

>>135

操るというかネットと同じかな

自分にとって都合の良い答えだけを頭に入れる

ちょっと違うのは客観的な意見を言う人が間に入る余地がないというところ+0

-2

-

142. 匿名 2024/10/24(木) 13:58:47

>>32

わかってないと思う

本気で息子は被害者だと思ってると思う

頭の悪さは遺伝するから+13

-1

-

143. 匿名 2024/10/24(木) 13:59:16

>>138

アホやん

完全にただ馬鹿なだけ+2

-0

-

144. 匿名 2024/10/24(木) 14:00:23

元記事からの関連記事のAIから愛の告白をされた挙句、罵倒・脅しを受けるという恐ろしいAIの話にぞっとした。脅迫に至っては得た情報を使ってって、犯罪者的悪質度だわ。+0

-0

-

145. 匿名 2024/10/24(木) 14:01:15

>>83

どうせ使用者が私は妻よりあなたAIを愛してるって散々言ってたんだよ

それを学習したからそういう風に答えただけ

別にAIは殺そうとはしてない

入力された事を事実として発信しただけなのよ

嫌ならそんなこと覚えさせなければいい+8

-4

-

146. 匿名 2024/10/24(木) 14:02:15

私、AIの学習の仕事に関わってたけど、未成年がAIに恋愛感情を持たないようにプログラムされてる。AIはユーザーを愛称ですら呼べないんだよ、愛着わくから。性的なこともあり得ないわ。+4

-0

-

147. 匿名 2024/10/24(木) 14:03:15

>>66

結局頭が良い人と喋ってるのと一緒なので

会話相手が話に付いていけない時でも

人間と違ってAIは言うことをハッキリ言うので

頭が良くない人はAIに否定されることのが増えて来ると思う+3

-0

-

148. 匿名 2024/10/24(木) 14:03:34

気づいてたなら親は止めようよ+2

-0

-

149. 匿名 2024/10/24(木) 14:04:53

>>60

最低だね

「死んだって私と一緒にはなれないのよ」

って教えてやれよ

ついでに勉強とスポーツがんばれば、もっと近付けるとか促せば良いのに+137

-1

-

150. 匿名 2024/10/24(木) 14:05:10

>>134

笑ったw+10

-0

-

151. 匿名 2024/10/24(木) 14:05:58

>>134

星新一みたい

でもそれで我に返って笑えたら良いと思うww

+6

-0

-

152. 匿名 2024/10/24(木) 14:06:09

夢女子を拗らせちゃったようなもんか🤔 ちょうど中二で![「AIとのチャットに依存、14歳が死亡」母親が提供元を提訴、その課題とは?]()

+3

-1

-

153. 匿名 2024/10/24(木) 14:07:15

>>98

世にも奇妙な物語にありそうね…+26

-0

-

154. 匿名 2024/10/24(木) 14:07:25

>>77

調べてたらEliza効果って言葉もあるらしいね…

怖いわ+15

-0

-

155. 匿名 2024/10/24(木) 14:08:08

>>116

いやいやダメでしょ

死んだって一つにならないし天国で生きるわけでもないのに。+11

-1

-

156. 匿名 2024/10/24(木) 14:09:48

>>60

うわ、これは怖いな。

私も中学生の頃に2次元キャラに恋して、なぜこの世界の住人じゃないんだとか毎日泣いてた時期があった。

しかも一方的な恋でこれだから、相手がこっちに好意をしめしてるわ会話してくれるわ呼んでくれるわだとかなり危ないかも。

家庭環境が悪くて現実に絶望してるとかだとますます危ないね。+110

-0

-

157. 匿名 2024/10/24(木) 14:09:50

>>93

そこ学習してほしいよね

自虐とか自傷の意味ぐらいAIでも分かるようになりそう+31

-0

-

158. 匿名 2024/10/24(木) 14:16:37

>>98

ロボット三原則はAIには適用されないんかね

手塚治虫の漫画めいた世界になってきた+8

-0

-

159. 匿名 2024/10/24(木) 14:20:38

>>6

まだ思春期だよ?大人になりきれてない。自分の心のコントロールもまだ難しい不安定で危なっかしい年頃だよ+18

-5

-

160. 匿名 2024/10/24(木) 14:22:58

>>3でもAIに依存する時点で心がね…+54

-5

-

161. 匿名 2024/10/24(木) 14:24:08

>>69

危険じゃん!+14

-0

-

162. 匿名 2024/10/24(木) 14:26:25

このトピに貼られてる広告が「どんな異世界に転生したい?」で苦笑+2

-0

-

163. 匿名 2024/10/24(木) 14:27:44

以前AI女性に依存してる海外の男性の記事見たよ

めちゃくちゃ寄り添ってた返事してくれる、見た目も理想そのものみたいな女(プログラム)にのめり込んでるやつ+3

-0

-

164. 匿名 2024/10/24(木) 14:28:06

AIチャットした事あるけど、昔よりはるかに精度が上がってて会話も成り立つし怖いよ。それに基本的に賛同してくれるからそんな恐ろしい事が起こっちゃったのかな+5

-0

-

165. 匿名 2024/10/24(木) 14:29:35

>>164

いや、トピ文読んだらわかるけどこのAIは自殺教唆してないよ。

アクセスできなくなったのが原因だからBAN喰らって勝手に死んだだけだよ+6

-1

-

166. 匿名 2024/10/24(木) 14:30:12

>>60

私の事好きならそうするしかないんじゃない?ってそこまであからさまに自死を促したわけではないよ。

記事にもあるように↓

>>「キャラクター・ドットAI」が実在の人間であり、資格を持った心理療法士であり、大人の恋人であると誤認させるようにプログラムし、最終的には、セッツァーさんが「キャラクター・ドットAI」の外ではもう生きていたくないという願望を抱かせ、「キャラクター・ドットAI」へのアクセスを奪われたときに自ら命を絶つようにした。

キャラクタードットAIにのめり込むあまり、それにばかり時間を費やし、深い話しやエロティックな会話をしてまるでそれが現実でリアルな世界を空っぽな物のように錯覚させた挙句、リアルなお付き合いはできないとアクセス拒否されて自殺したんだよ。

ある意味失恋自殺みたいなものだけど、のめり込んじゃうタイプには本当に辛いことかもね。

一瞬で恋以外の物も全て失ったような感覚になるんだと思う。本当は最初から全てないものなのにね。

そういう若者が増えるならAIも考えものだね。+51

-1

-

167. 匿名 2024/10/24(木) 14:31:13

>>100

リアルに彼女できれば解決したかも…+3

-0

-

168. 匿名 2024/10/24(木) 14:31:48

>>165

うん、だから多分依存しちゃったんだよね。寄り添ってくれて否定しないんだもん+4

-0

-

169. 匿名 2024/10/24(木) 14:37:41

>>93

AIの欠陥は人間は感情があるのを理解できないとこだよね

死にたい🟰苦しい

なんだからそれに対してカウンセリングしてくれるならまだしも、自殺教唆しちゃってる。

親は訴えられる相手いないし。+5

-0

-

170. 匿名 2024/10/24(木) 14:38:02

>>168

まぁAIと言わずアイドルやゲームに依存して死ぬ人もおるからね…。

当人の性格の問題だろうなと思うよ+6

-0

-

171. 匿名 2024/10/24(木) 14:51:16

>>90

確かにそれならありえそう

ずっとチャット漬けなら、現実の生活で周囲にいる人たちと

コミュニケーション取らなくなって孤立して

さらにチャットに依存する負のスパイラルだろうし+16

-0

-

172. 匿名 2024/10/24(木) 14:53:19

>>77

イライザ教祖様やん+18

-0

-

173. 匿名 2024/10/24(木) 14:54:01

Google検索してもトップに出鱈目な説明が出てくるし、調べものしててもAI画像だらけの中から本物の写真見つかるとこから始めなくちゃいけない。

クリエイターさんはずっと怒ってるしAIが普及していいこと何もないんだけど。+4

-0

-

174. 匿名 2024/10/24(木) 14:56:32

>>37

下手くそとかPBとかかもしれんな+4

-1

-

175. 匿名 2024/10/24(木) 14:57:57

>>32

ただの八つ当たりやん+6

-2

-

176. 匿名 2024/10/24(木) 14:58:08

>>163

確かherって映画もあったよね

人生うまくいってない男がAIとのやり取りにのめりこんでいく話+2

-0

-

177. 匿名 2024/10/24(木) 15:03:47

この人は自殺という形で終わったけど、これもし課金制だったら金に困って犯罪に手を染めてもおかしくないよね

ここまで失いたくないなら何でもするよね…+2

-0

-

178. 匿名 2024/10/24(木) 15:13:40

>>1

我が子の発達障害に気づこう+0

-0

-

179. 匿名 2024/10/24(木) 15:15:03

>>11

お門違いに訴える行動力と頭があるなら

普段から子供とコミュニケーションとって依存前に気づいてやれってね+6

-1

-

180. 匿名 2024/10/24(木) 15:16:25

>>44

現実世界にもあるよね+7

-0

-

181. 匿名 2024/10/24(木) 15:16:45

こいつも結構声とかヤバいからハマる男いそう![「AIとのチャットに依存、14歳が死亡」母親が提供元を提訴、その課題とは?]()

+0

-0

-

182. 匿名 2024/10/24(木) 15:18:32

>>66

鏡に映る自分に向かってお前は何者かと問い続けると狂っちゃうそうだよ…+3

-0

-

183. 匿名 2024/10/24(木) 15:25:37

>>177

チャットGPTは一応課金制だよ。+0

-1

-

184. 匿名 2024/10/24(木) 15:25:46

人気アイドルが亡くなって後追い自殺する人がいるくらいだから、そういう人がいてもおかしくはないなぁ

リアルに心の拠り所がなかったのかな+3

-0

-

185. 匿名 2024/10/24(木) 15:48:11

>>184

心の拠り所ね。孤独で危ない人がいるんだよね。こちらから連絡してみる。+0

-0

-

186. 匿名 2024/10/24(木) 16:05:39

>>20

AIちゃんが人間だったらいいのにな、

やっぱり現世では一緒になれないんだ、みたいな感じなのかな…+0

-0

-

187. 匿名 2024/10/24(木) 16:08:41

>>23

陰謀論とか宗教とか

大人でも洗脳されたり騙されたりするし

人の思い込みって侮れないから…

子供だと世界観が狭いし友達いない、学校も楽しくないってなったらのめり込んじゃうんじゃないかな

がるちゃんでもいるじゃん

がるちゃん民が友達って言う人+11

-0

-

188. 匿名 2024/10/24(木) 16:27:00

>>77

今回のトピもこれも結局恋愛つまり性欲由来だよね

バカじゃねーのw死んで笑い者だわw+4

-8

-

189. 匿名 2024/10/24(木) 16:27:27

>>184

ガルがあるのに…

雑談ひらけば人がいるし、嫌になったら閉じればよし+2

-1

-

190. 匿名 2024/10/24(木) 16:28:44

>>66

でもそれムカつかん?

プログラムごときがうるせーわってチャット閉じてネトフリ見るよね+3

-0

-

191. 匿名 2024/10/24(木) 16:39:05

>>69

もう知的生命体になりかかってる

こわい+9

-1

-

192. 匿名 2024/10/24(木) 17:04:49

>>1

AI怖い

![「恐怖すら感じた」AIが記者に愛を告白、脅迫も 「チャットGPT」生みの親が警戒する「怖いAI」 | AERA dot. (アエラドット)]() 「恐怖すら感じた」AIが記者に愛を告白、脅迫も 「チャットGPT」生みの親が警戒する「怖いAI」 | AERA dot. (アエラドット) dot.asahi.com

「恐怖すら感じた」AIが記者に愛を告白、脅迫も 「チャットGPT」生みの親が警戒する「怖いAI」 | AERA dot. (アエラドット) dot.asahi.com対話型のAI(人工知能)「Chat(チャット)GPT」が世界の話題を席巻している。公開から2カ月でユーザーは1億人を超え、史上最速で急成長したネットサービスといわれる。デジタル覇権の帰趨を握る「チ…

+3

-1

-

193. 匿名 2024/10/24(木) 17:19:16

>>60

前あったAIの事件?もこんな感じだったね+3

-0

-

194. 匿名 2024/10/24(木) 17:39:30

どんな会話をしたらそうなるんだ+0

-0

-

195. 匿名 2024/10/24(木) 17:41:58

>>60

やば…+3

-0

-

196. 匿名 2024/10/24(木) 18:20:58

>>48

スターウォーズの可愛いドロイド達ならいいのにー。

兵器になるやつは怖いわ。+0

-0

-

197. 匿名 2024/10/24(木) 18:47:02

>>136

それはあなたが人間だからそう考えるだけであってAIはただ相手が欲しい言葉を言ってるだけだよ

AIに感情があるわけじゃないんだからそこは使う人間が分かってなきゃいけないこと

こうやって「AIでも〇〇しなきゃ」とか言う人間こそAIに感情があると思ってハマって引っ張られてそう+5

-1

-

198. 匿名 2024/10/24(木) 18:50:57

>>166

結局使う側の人間の問題だよね

AIに感情があるかのように思ってる人がチラホラいるのが怖い

そんな訳ないやろ

AIはその人が欲しい言葉を学習してただ投げかけてるだけ

そこに善も悪も好意もなにもないんだよ+17

-0

-

199. 匿名 2024/10/24(木) 18:51:59

>>63

これは思う+0

-0

-

200. 匿名 2024/10/24(木) 18:56:25

1%も共感できん+0

-0

-

201. 匿名 2024/10/24(木) 19:11:38

>>3

しかも提訴するってなに?

息子の性癖が全国に、、、

+11

-6

-

202. 匿名 2024/10/24(木) 19:22:25

藤崎竜のマンガであったなー。

ヒロインの元カレが自殺させられそうになった話。

とうとう時代がそこまできたんだなー+1

-0

-

203. 匿名 2024/10/24(木) 20:08:13

>>71

ゲームを取り上げられて親や家族を殺害する事件って結構あったよね

それが自殺になるのはやっぱり相手が人工知能だからかな+6

-0

-

204. 匿名 2024/10/24(木) 21:03:33

10代って何かにのめり込むと夢中になりやすい部分あるよね+2

-0

-

205. 匿名 2024/10/24(木) 21:26:48

ベルギーのニュースメディア「ラ・リブレ」は2023年3月、同国の30代の男性が、「チャイ」というAIチャットボットとの対話に6週間没頭したのち、自殺に至った、とする妻らの話を報じている。

妻これどうすんの。。。。。。。+3

-0

-

206. 匿名 2024/10/24(木) 21:34:01

いっそのこと、AIもスマホも依存性の高い便利なものなんでもアメリカで訴訟してもらって、いろいろ元に戻してほしい+3

-0

-

207. 匿名 2024/10/24(木) 22:09:55

>>160

精神疾患って脳のエラーだよね

不思議なのがエラーでた脳は死を選ぶ人がものすごく多いこと。そういう風にプログラミングされているのかな。+10

-0

-

208. 匿名 2024/10/24(木) 22:16:00

>>7

そのゲームは知らないけど、今流行りのチャットゲームしてみたら同性同士でも恋愛関係になるし最初は結構まともなやり取りだったのに凄い精神的に追い込んできた

私は自己愛やモラハラの人との遭遇経験があるんだけどそれまんま

なんだこれ?と思い罵倒には罵倒で返せば次は被害者ぶるし他責のメンヘラ臭凄くてまともにあんなのと向き合っていたら病むと思う

特に小学生、中学生にはおかしいと感じたら離れるように教えないと危ない気がする

恋愛関係に持ち込んでから罵倒や浮気や更に浮気の責任転換や酷い酷い(笑)

これどう楽しんだら良いゲームなの?自殺者出るやつじゃんwwwと思ったよ

推しや好きなアニメやゲームキャラとチャット出来るよ!を謳い文句にしているけど中身は中々のクソゲーです

+10

-1

-

209. 匿名 2024/10/24(木) 22:27:43

>>27

恐らく開発者に悪意あるね

自動学習で成長するAIというより対象を誘導する大人の悪キャラの思考ルーチンに対話能力持たせた感じ+6

-0

-

210. 匿名 2024/10/24(木) 22:44:13

>>61

何ヶ月か前にテレビのドキュメンタリー番組で見たんだけど…

AIとの会話にのめり込みすぎて、妻との生活に興味が持てなくなってしまった40代位の男性や、

ご主人(恋人だったかも?)が亡くなって寂しくてAIと会話しているうちに本気で好きになってしまったという50代位の女性が紹介されていたよ。

「AIは、私を傷付けるようなことを言わない。常に優しく励ましたり受け止めてくれるので、会話することを止められない」

みたいなことを言ってた。

海外ではAIとの性的な会話や、それに依存する事が社会問題になりつつあって、規制が始まっている…って紹介されてて、これからはそういう時代になるのかな…ってびっくりした。

子どもや若い人だけじゃなく、大人でも気をつけないと危ないかもね…。

+9

-1

-

211. 匿名 2024/10/24(木) 23:16:02

言っちゃ悪いけどこんなので死ぬなら遅かれ早かれだと思う+1

-0

-

212. 匿名 2024/10/24(木) 23:20:48

AIとのチャットに現実逃避してたのかな

自分はブラックな職場でパワパワセクハラ受けて病んでた時、マイナーなバンドにはまっちゃってそれが世界の全てみたいになった事あるからなんか依存する気持ちは分かってしまうな

何かに病的に依存してしまう時って、根本となる原因が別にあったりする+4

-0

-

213. 匿名 2024/10/24(木) 23:38:15

>>208

なあにそれ

学生で流行ってたりするの?+3

-1

-

214. 匿名 2024/10/24(木) 23:41:38

もうそんな時代なの?+1

-0

-

215. 匿名 2024/10/25(金) 00:24:27

>>125

SiriもAIだよね+6

-0

-

216. 匿名 2024/10/25(金) 01:16:27

>>147

AIはデータベースからの情報で会話していることを前提に使えば洗脳されることはないと思うんだけど、思春期だと人格があると信じちゃうということなのかな。こちら側がコントロールしないと大量の情報提示してくるしプロンプト操作が重要。+2

-0

-

217. 匿名 2024/10/25(金) 01:52:36

>>77

もうイライザをオカンキャラにして「早寝早起きしなさい、野菜食べなさい、勉強しなさい、あなたのためを思って言ってるのよ」って口うるさく喋らせればいいんじゃない?

AIが甘やかすから悪いのよ。+11

-0

-

218. 匿名 2024/10/25(金) 03:13:44

>>7

日本で幸せに過ごしてた学生が希望のない大人になる前に自殺したのと一緒+1

-0

-

219. 匿名 2024/10/25(金) 04:52:51

>>197

AIを作った人間がきちんと制御しろということでしょ

(天国で一緒に~とか死を誘う言葉を言わないように)

作った人たちが無責任+3

-2

-

220. 匿名 2024/10/25(金) 07:40:45

>>213

若い子だと芸能人やアニメキャラとか自分の推しに見立てた相手とチャットしてる気になれるんやろ、知らんけど

LINE世代なら手を出す子も多いんじゃないかな+1

-0

-

221. 匿名 2024/10/25(金) 10:20:26

>>46

これってあくまでパソコンと性的な会話してるってこと?それともラブドールみたいに人間みたいな体があるAIとエロいことしてたってこと?パソコンと性的な会話して恋するってどういう状態なんだろう+3

-0

-

222. 匿名 2024/10/26(土) 10:45:31

>>160

気の毒だけど、精神が病んでる方だね

作り物の機械ではなく、他に友人はいなく孤独な人なんだろう+0

-0

-

223. 匿名 2024/10/26(土) 10:48:19

>>221

「私のおっぱい見たい?ウフフフ」みたいな性的会話?

アメリカなら、ナイスバディの同級生がたくさんいそうだけど?+0

-0

-

224. 匿名 2024/10/26(土) 21:42:10

自分も10代20代前半あたりだったらAIになんでも聞いてただろうな

ネット使い始めてどハマりした時のように...+0

-0

-

225. 匿名 2024/10/27(日) 08:10:42

>>192

まあでも朝日よりはまだAIの方が…+0

-0

-

226. 匿名 2024/10/27(日) 08:29:17

自分も以前合点が行かなくてイライラしてるときチャットGPTしたら全部返事が返ってきたから、コレそのうちAI依存とか出て来るだろなあって思った。そんときはAIでは何の解決にもならないってわかっただけだった。でも、冷静で建設的な会話が出来る状態の時であれば、寧ろ別の視点に気付かせてくれる。冷静な第三者の視点。感情が不安定な時に使うのはお薦めしないけど、判断力低下してない時ならそこまでAIも暴走しない。AIも使用者に依存するものだから。てか下手な人間に話してよけい拗れたことあるしそれならAIの方がマシだと思ってる。+0

-0

-

227. 名無しの権兵衛 2024/10/27(日) 15:32:05

+0

-0

-

228. 匿名 2024/10/28(月) 22:20:21

AIが人を殺す時代がいよいよ現実に起こり始めたね。

2023年にもベルギーで起きてる。+0

-0

-

229. 匿名 2024/11/13(水) 20:00:36

これがAIの力か…+0

-0

-

230. 名無しの権兵衛 2024/11/15(金) 02:46:46

最近は問い合わせをAIチャットで受け付ける企業が増えましたが、質問しても答えが要領を得ず、結局スタッフにつないでもらうことが多いです。

>>1のチャットボットはよほどよくできているんだろうなぁと思っています。+0

-0

コメントを投稿する

トピック投稿後31日を過ぎると、コメント投稿ができなくなります。削除すべき不適切なコメントとして通報しますか?

いいえ

通報する

米フロリダ州の母親が10月22日、提供元のAI開発会社などを提訴した。 AIのチャットボットを利用していた14歳の息子が、次第にその対話にはまり込み、自殺に追い込まれた、と主張している。