-

9. 匿名 2025/06/23(月) 09:23:50

>>1

ChatGPTって、いかにも正しいかのような言い方が上手すぎるから

嘘すら信用してしまうんだよね

そこが怖い

前に、探偵ナイトスクープで泣ける話ないか尋ねたら

過去にまったく放送が無いものを3つくらい紹介してきた

いかにもありそうな話、過去の話を色々繋げたような内容で、勝手に作り上げててびっくりしたよ

+150

-0

-

11. 匿名 2025/06/23(月) 09:25:23

>>9

笑った+19

-3

-

26. 匿名 2025/06/23(月) 09:32:24

>>9

情報更新されてないのとかもよくあるよね

人気の飲食店を聞いて行ってみたら、かなり前に閉店してた+38

-0

-

34. 匿名 2025/06/23(月) 09:40:38

>>9

そうなる理由は、

AIに食わせてる日本語のデータ量が少ないのと、現在のAIのアルゴリズムに原因があると何となく思う

AIの仕組みは連想ゲームって言われてる

おそらくなんだけど、AIに学習させている大量のデータの中で、

こちらが入力した言葉と一緒に出てきやすい言葉を引っ張ってくる感じ

かなりファジーに関連付けしないと、

今のSiriみたいにネット上に答えが転がってるのに「答えられません」だらけになるのだと思う

ファジーに引っ張ってきてるから、データが十分でないと当然周辺にある言葉を適当に引っ張って文章を作ってしまう

「知らない」「わからない」を連発しない一方で、知らないわからないことはそう言えるようになる問題はまだ克服できてないんだろうと思う

とりあえず得意不得意確実にあるのを感じるから、得意なことだけ使ったらいい

自分は、博学でとにかく親切な同級生でたまにポンコツ、というとらえ方で使ってる+45

-1

-

41. 匿名 2025/06/23(月) 09:49:40

>>9

本を紹介してほしいと言うとかなり適当な回答してくれる

作者名で調べてもそんな本存在しなくて

無いって言ったら

すみません存在しませんでしたって簡単に言ってくるw

+50

-0

-

71. 匿名 2025/06/23(月) 10:19:59

>>9

漫画とか香水とかもめっちゃ間違えてるときあるわ。+9

-0

-

73. 匿名 2025/06/23(月) 10:26:43

>>9

お笑いコンビの〇〇のメンバーは誰ですか?って聞いたらバカリズム入ってて笑った

アイドルグループのメンバーとか俳優の出演作品とかもでたらめばっかり+6

-0

-

76. 匿名 2025/06/23(月) 10:41:26

>>9

〇〇県のどこどこに行くんだけどついでに寄ったらいい楽しい場所教えてみたいな質問した時、まったく存在しない施設3つくらい教えてくれた

所在地や営業時間までちゃんとのってるんだけど該当するところない

超おもしろいwくらいに捉えてないとまだダメだなと+13

-0

-

89. 匿名 2025/06/23(月) 11:28:16

>>9

同じ経験をしたよ

ある映画作品をGoogle検索したらAIによる回答が1番最初に出てきたんだけど、その内容の説明が、同じ監督による作品の代表作を勝手に繋ぎ合わせたみたいなデタラメなあらすじでビックリした

真顔でスラスラ嘘をつく人を目の当たりにした時みたいな、なんとも言えない気持ちになったよ

知らない人はまさか嘘だと思わず信じるよね

+16

-0

-

99. 匿名 2025/06/23(月) 12:44:16

>>9

すごくわかる

こういう感じのおすすめの小説ない?って聞いたら、この世に存在してない小説オススメされた笑

検索してもでてこないの

いかにも面白そうなあらすじで紹介してくれたか、無駄に期待しちゃった+6

-0

-

101. 匿名 2025/06/23(月) 13:09:07

>>9

課金したら変わるのかな+2

-2

-

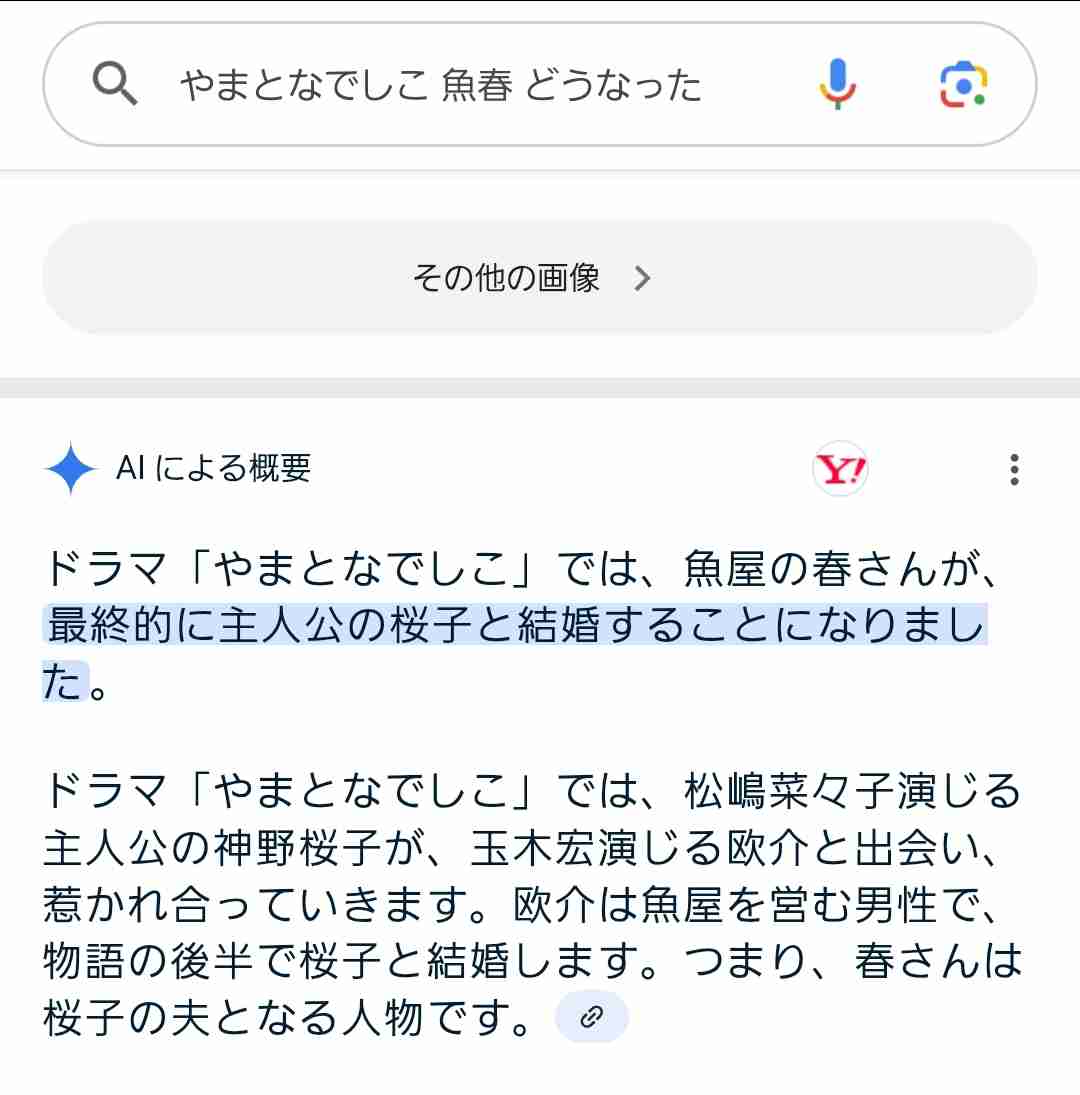

121. 匿名 2025/06/26(木) 21:16:34

>>9

この適当さよ。AIって、まじで信用したらダメな気がする。![]()

+8

-0

削除すべき不適切なコメントとして通報しますか?

いいえ

通報する