-

1. 匿名 2025/07/16(水) 00:31:19

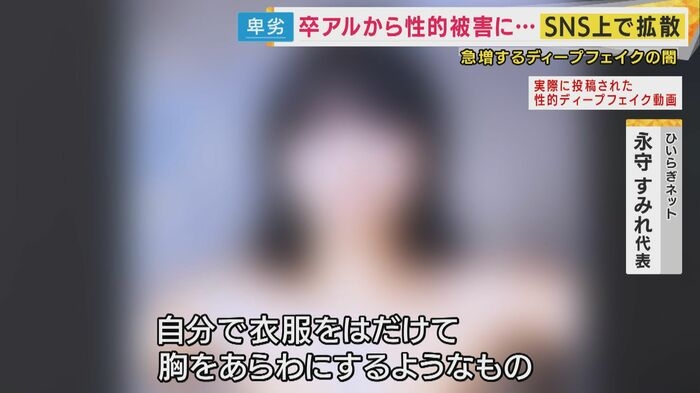

「ひいらぎネット」の調査によると、未成年者の性的ディープフェイクがことし3月~6月で252件、SNS上などで確認されたということだ。

そしていま悪用されているのが卒業アルバムだ。

実際に、コミュニケーションアプリを見てみると…「#卒アル晒し」という名前が付けられた項目が。

そして卒業アルバムとみられる名前が入った写真がずらりと投稿されている。

ひいらぎネット 永守すみれ代表:自分で衣服をはだけて胸をあらわにするようなもの、おそらく小学生だと思うが服を脱がされているようなものになります。

なんと小学生とみられる少女の写真を性的な動画に変えているものやSNSに投稿した写真を悪用され下半身に何も着けていないかのように加工された画像も。

驚くのは作成の依頼者が「同級生」の可能性もあるという。

性的ディープフェイクはどのようにして作られてしまうのか。

記者の写真を使用し実際に作成してみると…

わずか30秒ほどで、記者が着ていたはずの服が消えている。

記者:違和感ない。ここまで精度があるんですね。

ひいらぎネット 永守すみれ代表:本当に言われなかったらAIで脱がされたものってわからない。普通にこういう写真がもともとあったのかなって思うようなものが簡単に作れてしまうんですね。

+9

-178

-

2. 匿名 2025/07/16(水) 00:32:14

法整備はよ+799

-5

-

3. 匿名 2025/07/16(水) 00:32:29

SNSに顔載せたらあかんね+687

-6

-

4. 匿名 2025/07/16(水) 00:32:51

数年前にアメリカで被害あったのが日本で遅れて起こったのか?

+230

-6

-

5. 匿名 2025/07/16(水) 00:33:04

人類は滅亡した方がいい+181

-21

-

6. 匿名 2025/07/16(水) 00:33:38

男の性欲ってなんなの+485

-5

-

7. 匿名 2025/07/16(水) 00:33:48 ID:OjuWZByEix

新しい技術はいつも悪用される

顔すら安心して載せられなくなっている+227

-4

-

8. 匿名 2025/07/16(水) 00:33:52

生成するだけなら簡単だよね

私も推しの二次元キャラの濡れ場とか原作と同じ絵で出してる

外に出したらまずいからださないだけ+1

-41

-

9. 匿名 2025/07/16(水) 00:33:53

作成者の氏名が必ずわかるようにならないかな+339

-2

-

10. 匿名 2025/07/16(水) 00:33:57

鎖骨おかしくない?+144

-5

-

11. 匿名 2025/07/16(水) 00:34:13

まあ本物の全裸じゃないなら・・・

それでも嫌だけどね+6

-63

-

12. 匿名 2025/07/16(水) 00:34:22

ロリコンホイホイだからこれ作ったor持ってる時点で重く処すべき+182

-0

-

13. 匿名 2025/07/16(水) 00:34:29

>>2

フェイク動画かどうかの判断が難しいからネットのエロ全て禁止にすれば良いのになと思う。+248

-2

-

14. 匿名 2025/07/16(水) 00:34:44

>>3

卒アルでこれなら、SNSだと悪用され放題だね…+298

-2

-

15. 匿名 2025/07/16(水) 00:35:14

>>11

自分の娘の顔が勝手に利用されて性的おもちゃにされても??+124

-2

-

16. 匿名 2025/07/16(水) 00:35:35

>>3

学校とかもブログに生徒の顔を載せるのやめたほうがいいと思う+275

-2

-

17. 匿名 2025/07/16(水) 00:36:26

>>3

子供とか普通に載せてる人怖い

危機管理能力皆無+195

-0

-

18. 匿名 2025/07/16(水) 00:36:34

>>6

技術進歩の原動力+11

-44

-

19. 匿名 2025/07/16(水) 00:37:21

>>11

SNS怖いよー

それが真実だって拡散されて行くから

日本だけじゃなくて世界でオモチャにされるよ+63

-0

-

20. 匿名 2025/07/16(水) 00:37:31

>>11

第三者から見たら本人がやってる画像と思うから、例えば婚約破棄や内定破棄、退学処分、降格処分などの被害も起きるかもよ

多くはそっちの意味の被害が深刻になると思う+149

-1

-

21. 匿名 2025/07/16(水) 00:37:37

はたしてAAAカップの私はAIだと何カップになるのかな?+1

-14

-

22. 匿名 2025/07/16(水) 00:38:03

>>3

マッチングアプリも危ないよ+87

-2

-

23. 匿名 2025/07/16(水) 00:38:14

>>6

エロは世界を平和にするとか言ってるバカがいるけど、度を超えて女に精神的・肉体的苦痛を与えたら死刑でもいいと思うわ

+257

-3

-

24. 匿名 2025/07/16(水) 00:38:31

ドラえもんの時代!?😮+1

-1

-

25. 匿名 2025/07/16(水) 00:39:24

>>2

こういうのは本当に遅い

政治家が性犯罪者に甘すぎる+126

-2

-

26. 匿名 2025/07/16(水) 00:39:36

>>2

世界一の被害者![中高生や小学生まで被害に…”生成AIでわずか30秒 服脱いだ画像作成”「性的ディープフェイク」の実態]()

+47

-7

-

27. 匿名 2025/07/16(水) 00:39:42

>>2

鳥取がやっと動いたけどこれが限界なのかなぁ、盗撮もコロナ禍前までは自治体の迷惑条例とかだったよね

仮に厳罰化されても盗撮くらいにしかならんか…?

>条例を今年の4月に施行しました。来月から以下の罰則が強化されるということだ。

・5万円以下の過料

・画像の廃棄・削除の命令

従わない場合には…

・追加で5万円以下の過料

・氏名の公表も+32

-0

-

28. 匿名 2025/07/16(水) 00:39:58

>>17

この前もブログに全裸の女の子載せてる人いましたよ

コメ欄気持ち悪かった+38

-1

-

29. 匿名 2025/07/16(水) 00:40:35

社員録に直近の顔写真掲載が義務付けられてる会社とかほんとクソだと思う

管理職のリテラシーマジでクソ

っていうかディープフェイク作るつもりで強制してんのかな

悪用された場合どういう責任をとってくれるのか人事部にでも聞いてみたい

+86

-3

-

30. 匿名 2025/07/16(水) 00:40:43

死刑で+11

-0

-

31. 匿名 2025/07/16(水) 00:40:47

発想が気持ち悪すぎて。

なぜ、そんなにも幼い子が好きな男が多いのか、、、。+73

-2

-

32. 匿名 2025/07/16(水) 00:41:12

>>4

たぶんそれ

向こうでは同級生の女の子達を生成AIで裸にして男達が仲間内でばら撒いてるのが問題になってた

遂に日本にも来た感じだね

若い子達は自分から動画をアップしまくってるから、たくさん作られちゃうね+152

-2

-

33. 匿名 2025/07/16(水) 00:41:36

>>2

性犯罪全体を重罪にした方がいいよね

手を出したら人生終わる方が抑止力になる+80

-2

-

34. 匿名 2025/07/16(水) 00:41:39

>>6

昔からあったんだろうけどさ、最近性犯罪のニュース多すぎて吐き気する

外国みたいに刑罰は鞭打ちとかにして欲しい+220

-2

-

35. 匿名 2025/07/16(水) 00:41:54

>>2

私もリベンジポルノとかされてたら怖いわ

小学生なら明らかにやばいから消してもらえてたりするんだろうけど

高校生以上って見た目じゃ年齢わからないだろうし、自分で見つけなきゃ誰も助けてくれないのマジで困るんよ

投稿するとき、双方の本人確認とかあればいいんだけどな…+89

-2

-

36. 匿名 2025/07/16(水) 00:42:24

別のトピで、ジャンボリお姉さんが上半身裸っぽい写真載せてあったけど、それもディープフェイクなのかな

ほんと気持ち悪い🔥

+28

-1

-

37. 匿名 2025/07/16(水) 00:43:02

>>1

男性の顔は違和感ないけど鎖骨はおかしくない?+39

-1

-

38. 匿名 2025/07/16(水) 00:43:41

>>6

あいつら常に理性を失ってるキ□ガイだからな。

+88

-4

-

39. 匿名 2025/07/16(水) 00:43:59

>>31

脳が幼稚なんでしょうね…

成熟した女性だと支配できないから+35

-1

-

40. 匿名 2025/07/16(水) 00:44:36

性関係の犯罪は全て厳しくして!!!

レイプは即死刑で。

再犯率多くて毎回思う

本当は盗撮も全て何もかも極刑にしてほしい+67

-2

-

41. 匿名 2025/07/16(水) 00:44:55

>>3

可愛いインフルエンサーなんて素材だらけということだね+38

-1

-

42. 匿名 2025/07/16(水) 00:45:05

>>3

卒アルは避けようがない+68

-1

-

43. 匿名 2025/07/16(水) 00:46:05

生成AI禁止にしろ+14

-1

-

44. 匿名 2025/07/16(水) 00:46:18

>>2

規制ばっかりで息苦しい世の中+3

-19

-

46. 匿名 2025/07/16(水) 00:47:56

>>3

載せまくってるから完全に若い子達はアウトでしょう+22

-0

-

47. 匿名 2025/07/16(水) 00:48:23

>>1

TikTokのマーメイドになるエフェクトも一種のディープフェイクだろ+5

-1

-

48. 匿名 2025/07/16(水) 00:50:12

>>26

桐山アンちゃんのやつXのアカウントなんかな

+5

-1

-

49. 匿名 2025/07/16(水) 00:51:52

>>29

自己レスだけどクソはいいすぎだったかもね

すいません

会社側も従業員管理の都合もあるし

色々あるのは全然理解できる

ただそれって絶対に直近の顔写真を社員録に掲載することだけでしか管理できないことなのか?という疑問がわく

一方で、社員なら誰でも見られてコピーもできるところに顔写真っていうのは従業員の安全考えたらよくないというのも普通に理解するべきかと

社員同士の交流のためだけに顔写真を公開しよう!みたいなのは流石に悪用のリスクが高い今の時代的に厳しいと思う+15

-0

-

50. 匿名 2025/07/16(水) 00:52:23

>>27

加害者の氏名年齢職業・顔写真・住んでる地域は即公表するべき

人を卑劣な方法で晒し者にしたんだからこのぐらいは当然のはずじゃ?+49

-2

-

51. 匿名 2025/07/16(水) 00:52:32

AIが優秀なのはよくわかったけど、本当になんで小学生なの??

ボンッキュッバーンなお姉さんに欲情しないの本当になんで??

これを見て喜んでる人が本当に理解不能

それはさておき、ネット情報は全て身分証がタグ付けされてほしいな

マイナンバーで管理すればいいじゃん

情報発信は自己責任なんだから

それもあっという間に悪用されそうだけどさ+35

-1

-

52. 匿名 2025/07/16(水) 00:53:23

>>1

そもそも卒アル廃止でよくない?

卒業式の日に即捨てたわ+63

-0

-

53. 匿名 2025/07/16(水) 00:53:23

>>1

このアプリを使われたら更に女性は大変なことになる

若い女の子のお子さんがいる人たちに読んでおいた方がいい

アメリカなどで問題になってるし日本でもこのアプリは普通に使える![AI搭載のヌード化アプリ「Clothoff」の知られざる詳細を内部告発者が暴露、運営は旧ソ連圏に関係している可能性|au Webポータル経済・ITニュース]() AI搭載のヌード化アプリ「Clothoff」の知られざる詳細を内部告発者が暴露、運営は旧ソ連圏に関係している可能性|au Webポータル経済・ITニュースarticle.auone.jp

AI搭載のヌード化アプリ「Clothoff」の知られざる詳細を内部告発者が暴露、運営は旧ソ連圏に関係している可能性|au Webポータル経済・ITニュースarticle.auone.jp実在の人物の画像から偽のヌード画像(フェイクヌード)を作ることができるアプリ「Clothoff」は、アメリカやスペインで男子生徒らが女子生徒のヌード画像を生成し共有するという事件が発生するなど、問題を

+31

-2

-

54. 匿名 2025/07/16(水) 00:53:42

>>2

画像だけでなく動画や音声までAIで作られていくの怖すぎる+22

-0

-

55. 匿名 2025/07/16(水) 00:55:52

>>6

小学生女子とか赤ちゃんに対して興奮することを「性欲」とは呼ばないと思う

ロリコン本人は性欲だと思ってるのかもしれないけど、これは支配欲、蹂躙欲、嗜虐性、凌辱欲だよ

自分に自信がない日本のキモ男は成熟した女性が怖くて、未成熟な子供を汚そうとする+160

-6

-

56. 匿名 2025/07/16(水) 00:56:13

>>6

男っていうか日本人男性だよね

小中高で性犯罪やっても「いたずら」で許されて誰も怒らないしお咎めもないんだから+84

-5

-

57. 匿名 2025/07/16(水) 00:57:58

そのうちAVに出たことないのに捏造されたり、実際に出た人がディープフェイクと言い張れるようになるかも+37

-0

-

58. 匿名 2025/07/16(水) 00:58:21

>>6

重度の性犯罪者は離島に隔離して、VRディープフェイクとオ〇ホにティンティンして氏んでいっていただきたい。+23

-1

-

59. 匿名 2025/07/16(水) 00:59:15

そのままの画像を使うから犯罪になるのであってAi加工すりゃ似てことなる人になる。もう止めようないだろな。+1

-0

-

60. 匿名 2025/07/16(水) 00:59:43

>>3

ホームページに従業員の顔載せてる会社あるけどあれもやめてほしい 社内向けのコラムでも嫌すぎる+105

-0

-

61. 匿名 2025/07/16(水) 01:01:07

鎖骨が気持ち悪い。冷静になれば違和感に気づきそうだけど、本当に顔出しって怖い+2

-0

-

62. 匿名 2025/07/16(水) 01:06:29

>>41

インフルエンサーなら加工してるから大丈夫だよ

ヤバいのは素顔のまま載ってる卒アルの転載じゃない?+36

-1

-

63. 匿名 2025/07/16(水) 01:06:40

>>52

マイナス、負の遺産でしかないよね怒

時代錯誤でしかないし、誰かしらに確実にSNSやってない人間も無断で知らずバラ撒かれてるし…怖

気付いた時には時すでに遅し

デジタルタトゥーとして半永久的に残るし、削除されてもそれ以前に不特定多数に保存されてて終了

一度誰か一人にでも肖像権勝手に取られたら終わり

+28

-0

-

64. 匿名 2025/07/16(水) 01:06:57

>>20

それによって鬱発症とか引きこもるとか、精神的苦痛もすごそうだよね+31

-0

-

65. 匿名 2025/07/16(水) 01:08:11

>>6

国が法整備するより、男を減らした方が早い気がする

この国の性犯罪に対する興味のなさは異常+41

-10

-

66. 匿名 2025/07/16(水) 01:11:07

>>23

度を超えた性欲は弊害の方が大きい

進歩しても結局は不幸になるなら何もしない方がマシ+26

-1

-

67. 匿名 2025/07/16(水) 01:12:25

>>2

国会のおじさん達対応できないよ

チームみらいに期待+21

-0

-

68. 匿名 2025/07/16(水) 01:13:07

>>17

そういう人から彼氏の写真送れって言われたけど断った

そしたら、私は悪用なんかしないのに悲しいーって

危機感能力ないから怖いわ+17

-0

-

69. 匿名 2025/07/16(水) 01:17:16

クズとロリコンしかいない国+16

-1

-

70. 匿名 2025/07/16(水) 01:17:39

そら少子化なるわ。クソロリコン+10

-1

-

71. 匿名 2025/07/16(水) 01:19:08

己の需要もないのに20過ぎたらオバサンとか書き込んでたオッサン。お前今いくつだよ笑+10

-0

-

72. 匿名 2025/07/16(水) 01:23:47

>>14

すでに卒アルをwebに載せて、ロリコンからリクエストのある女子を盗撮して、データ売買してるんだよね。

撮ってるのは女子だったりするらしい。

NHKで見た。+38

-2

-

73. 匿名 2025/07/16(水) 01:29:01

>>26

えっ⁉️どうしてなのかな 何かあったの('_'?)+6

-1

-

74. 匿名 2025/07/16(水) 01:30:11

>>6

ってか暇なん?って思う

こんな作り物を作って何になるのと思う。+16

-4

-

75. 匿名 2025/07/16(水) 01:34:05

>>20

そう考えると男性も他人事じゃないね。

自分が路上で全裸になってる姿とか痴漢してる瞬間とか、特に政治家なんてそんな写真ディープフェイクで作られたらめっちゃ困るだろうから法整備すぐやらないかな。+59

-0

-

76. 匿名 2025/07/16(水) 01:40:47

賢い親ならちゃんと子供に言い聞かせてる

アホな親の多い関西はまぁそこら中でアホな子供が動画撮りまくってる+0

-4

-

77. 匿名 2025/07/16(水) 01:45:46

>>62

横だけど確かに!今の子たち加工しまくってて本人かどうかわからないレベルなの理解できなかったけど、

ある意味で防犯になってて加工もいいのかもね。+15

-0

-

78. 匿名 2025/07/16(水) 01:47:53

>>3

マチアプに写真載せてるやつも悪用されてるよ

+6

-0

-

79. 匿名 2025/07/16(水) 01:53:12

>>22

マイナンバーカードの画像が漏洩する可能性は?+3

-0

-

80. 匿名 2025/07/16(水) 01:54:24

>>72

教員もやっとるやろ+18

-0

-

81. 匿名 2025/07/16(水) 02:03:47

>>32

子供の卒アル、みんな普通に載るよね

でも卒アルは一度渡されたら手元にずっとあるし、悪意あればし放題になりそう

でも個人写真拒否したら自分の子だけ浮くだろうし子供嫌がるかな…どうしよう。+24

-2

-

82. 匿名 2025/07/16(水) 02:06:30

>>1

法で処罰を+1

-1

-

83. 匿名 2025/07/16(水) 02:08:05

>>9

キン肉マンの「肉」みたいに、作成したやつの額に「ロリコン」って焼印入れるのがいいよね。+26

-0

-

84. 匿名 2025/07/16(水) 02:54:34

芸能人みんなAIでいいよね、とかいう人いるけど

こういったディープフェイク蔓延するよね

それもよくないんだけど+2

-0

-

85. 匿名 2025/07/16(水) 03:03:18

日本で迷惑してた、なんとかさまり?ってチビ黒人

韓国で捕まったけど

こういうAIで性的な動画作って公開してつかまったね

あっちだとかなり厳しいの知った

日本も厳しくしたら良いのに+4

-0

-

86. 匿名 2025/07/16(水) 03:04:12

これはさすがにサービス提供してる側に罰則付きの規制かけれよ。

+7

-0

-

87. 匿名 2025/07/16(水) 03:13:06

>>3

ママ垢でよく名前の横につけてると何歳の子供がいるとわかるやつはやめたほうがいいんだって

同じ年齢の子供持つママと繋がりたいからつけてるのかもしれないけどそれで変態も検索して子供の画像保存するから+15

-0

-

88. 匿名 2025/07/16(水) 03:20:58

>>23

男がいくら満たされても現実の女性が傷付いて男嫌いになったり精神病んだりする量を野放しで増やしていったら結局は男が現実で女性と満たされる機会を減らすだけなのにね

一生 仮想現実の女だけで良いって人達なのか?

現実の女性の心なんか考えてない精神の欠陥なんだろうけど

+41

-0

-

89. 匿名 2025/07/16(水) 04:04:22

>>26

やりますねぇ!!+7

-1

-

90. 匿名 2025/07/16(水) 04:06:36

逆に言えば本物の裸ばら撒かれてもAIですって言い逃れ出来るってこと+2

-0

-

91. 匿名 2025/07/16(水) 04:30:20

>>6

キンタマーニ+3

-0

-

92. 匿名 2025/07/16(水) 04:48:32

まあここまで来たら無視が一番じゃない?そして自分で見ないこと。やがてスクランブル交差点ですれ違う人達みたいなもんになっていくと思う。ただ猥褻な部分は取り締まらないと。それは法にのっとってしっかりやってもらいたい+1

-0

-

93. 匿名 2025/07/16(水) 04:51:49

>>3

そりゃそうだけど卒アルまで悪用されるとどうしようもないね。あと教師の盗撮とかさ。

SNSなんかやってなくても巻き込まれる可能性があるのが問題なのでは。+22

-0

-

94. 匿名 2025/07/16(水) 04:55:05

>>26

810先輩!?+6

-1

-

95. 匿名 2025/07/16(水) 04:55:32

こわ〜い+1

-0

-

96. 匿名 2025/07/16(水) 04:59:04

![「親友にディープフェイクのポルノ画像を作られた」 英女性が真実を突き止めるまで - BBCニュース]() 「親友にディープフェイクのポルノ画像を作られた」 英女性が真実を突き止めるまで - BBCニュースwww.bbc.com

「親友にディープフェイクのポルノ画像を作られた」 英女性が真実を突き止めるまで - BBCニュースwww.bbc.comジョディー(仮名)はある日、自分の画像がディープフェイクで作られたポルノに使われているのを発見した。その後、さらにひどいショックを受けた。BBCのラジオ番組「ファイル・オン・4」の取材でジョディーは、この出来事の犯人が親友の一人だったと語った。

+1

-0

-

97. 匿名 2025/07/16(水) 05:36:26

てか、子供である私は危機管理能力高いほうで下手にsnsもやらず顔だって晒してなかったのに、危機管理能力には疎くて一般的な常識なかった親が勝手に顔晒したから最悪なんだけど

おかげで顔バレするし、こっちは苦労してるんだけど

別に芸能人になりたかったわけでもないのに、勝手にそういうことやるから本当思い返したら嫌いになりそう

別に承認欲求も高いわけじゃないのに、いちいち周りからは目立ちたがり屋とか思われているふうだし、本当うざいのだけど

子供の顔を晒す親ってどうかしていると思う

あとそこに協力した周りの人もうざすぎる

親なんか良い人扱いされていたけどどこが良い人か分からない

子供に対してどんな理由があれど、そういうことは普通の感覚あるならやらないはずだし

おかげで、こっちは振り回されるはめにもなったし迷惑している

なにが愛妻家だよ、ふざけんなよ、って思っている+11

-0

-

98. 匿名 2025/07/16(水) 05:49:41

>>42

いずれ卒業アルバムの顔写真は廃止になると思う

よく考えたら昔なんてクラス全員の住所や電話番号が明記された連絡網とか平気であったくらいだしね+33

-0

-

99. 匿名 2025/07/16(水) 05:56:59

二次元よりAIを規制した方がいいのでは

簡単にフェイクを作れちゃうし、一般人が被害にあうかも

詐欺とかに使われそう+4

-0

-

100. 匿名 2025/07/16(水) 05:57:54

ガルオバの自撮りもディープフェイクやろがい+0

-0

-

101. 匿名 2025/07/16(水) 06:00:41

今の子は大変だね

私らの若い時は、お店にフイルム持ち込んで現像してもらわないと写した写真が見れなかった時代で(何を撮ったかお店の人に見られてしまうから)変な写真撮れない時代だった+12

-0

-

102. 匿名 2025/07/16(水) 06:01:51

>>16

ぼかして載せてる学校もあれば、はっきり顔が分かる状態で載せてる学校もあって、教育委員会しっかりしてくれよって思う。

これじゃ校内での盗撮減らないよな、対策してないんだろうなって感じ。+29

-1

-

103. 匿名 2025/07/16(水) 06:07:17

>>14

動画とか声も悪用されてるんだってね

+6

-0

-

104. 匿名 2025/07/16(水) 06:13:26

>>101

それでも卑猥な写真を現像してもらう変態はいたんだろうなぁ+5

-0

-

105. 匿名 2025/07/16(水) 06:20:14

>>30

その場で射殺 死刑執行まで時間がかかる![中高生や小学生まで被害に…”生成AIでわずか30秒 服脱いだ画像作成”「性的ディープフェイク」の実態]()

+8

-1

-

106. 匿名 2025/07/16(水) 06:21:02

>>26

× 女の子

◯ おばちゃん+2

-0

-

107. 匿名 2025/07/16(水) 06:26:01

>>32

親はちゃんと叱って謝罪させたのかな

変な親だと自撮り載せる方が悪いと言いそうで怖い+9

-0

-

108. 匿名 2025/07/16(水) 06:26:45

>>81

幼稚園のアルバムも危ないだろうか+4

-0

-

109. 匿名 2025/07/16(水) 06:27:13

中国人がディズニーで大暴れして胸とパンツがさらけ出されたあれもAIのフェイクかな。

ワンピースが粗悪品でもない限り前のボタンが全部外れるとかまず無いし女性ならブラジャーだってつけてるはず+4

-0

-

110. 匿名 2025/07/16(水) 06:28:54

>>63

30年近く前に卒園した幼稚園は卒アルに入浴シーンが写っててお尻がはっきり見えてる子もいた

変態の手に渡ったら悪用されてたかも+12

-0

-

111. 匿名 2025/07/16(水) 06:30:00

酷いな+1

-1

-

112. 匿名 2025/07/16(水) 06:39:08

>>1

まぁAIが出来る以前からそーゆー事をする奴らは居るよね。服着た状態で作られてるフィギュアの表面をヤスリで削ってまでヌードにしたりさ。+5

-0

-

113. 匿名 2025/07/16(水) 06:47:01

>>60

わかる

悪用される想定ないんだよね+7

-0

-

114. 匿名 2025/07/16(水) 06:48:39

>>1

今更感

AIなんて

軍事とエロが先行する

平和利用は幻想

+8

-0

-

115. 匿名 2025/07/16(水) 06:55:15

>>5

いや、ほんと。遺伝子の操作といい、人間は神の領域を越えて手を出し過ぎてきてる。

そのうちバチが当たって取り返しのつかないことになるよ。+29

-3

-

116. 匿名 2025/07/16(水) 06:57:13

>>1

クラスメート裸にして巨乳のディープフェイク作り鍵垢でネットに上げて本人含めて友達と盛り上がっていたら親が見て今退学処分か揉めてるって話を聞いた+11

-0

-

117. 匿名 2025/07/16(水) 07:06:05

>>52

同じく捨てた

捨てるのも結構手間だった+8

-0

-

118. 匿名 2025/07/16(水) 07:10:33

>>6

修学旅行の風呂覗きもそうだけど、リアルに関わりのある女性をポルノに落とし込める神経がわからないよね。

同じ人間ではなく女体だと思ってなきゃできない。まともな男子はやらないけど、例えば女子と接点が持てなかった男とか青春を謳歌できなかったコンプ持ちとか大人になってから人生うまくいってない男がやるんだろうね。

一人で楽しむならまだしも、ネットで晒して男同士で共有して楽しむ文化が心底気持ち悪い。性欲とかの問題じゃなくて人格が歪んでる。動物殺して写真見せ合うのと同じだよ。女をこんな風に扱える俺!みたいな。+47

-2

-

119. 匿名 2025/07/16(水) 07:12:36

>>6

性欲は男女関係なくある

でも、男性の方がこういうのを作ったり性的なものをコソコソ作って仲間内でクスクス笑う陰湿な遊びをする傾向にある

本当に醜悪

「こんなことしちゃダメだよ」って嗜める男性はかなり少ない

そこの意識から変わってってもらわないとだわ

先ずは厳罰化だね

そうなれば面白がってこんな下衆な真似はしなくなってく(多分)+27

-2

-

120. 匿名 2025/07/16(水) 07:13:57

>>10

おかしいよね

怖いと思ったよ+10

-0

-

121. 匿名 2025/07/16(水) 07:26:59

>>5

本当にね。その方が他のあらゆる動物や地球のためにも良いだろうね。

人間はろくな事しないよね。+27

-1

-

122. 匿名 2025/07/16(水) 07:28:32

>>6

ロリコンは依存症だから。

精神科で治療を受けるべき病気。+5

-3

-

123. 匿名 2025/07/16(水) 07:29:12

せめてAI生成するなら顔も適当に好みのやつで架空の作らせろよ

わざわざ実在する人の顔使うのって相当な悪意も含まれてると思う

相手が嫌がる事まで織り込んだ上でやってる+7

-0

-

124. 匿名 2025/07/16(水) 07:35:04

>>121

今既に日本では熊や猪等、野生動物の逆襲が始まっている。+9

-1

-

125. 匿名 2025/07/16(水) 07:40:23

ガルに子の修学旅行の集合写真を載せてる人いて、顔に雑にモザイクかかってるけど一部の子にモザイクかかってなくて顔丸出しで、有り得んやろと思った。

こんな保護者迷惑すぎる。+4

-0

-

126. 匿名 2025/07/16(水) 07:41:10

今の子は普通に制服で学校でTikTok撮ったり

家の部屋からの景色エモい〜って載せたりしててマジ危機管理無さすぎて怖い+3

-0

-

127. 匿名 2025/07/16(水) 07:45:14

イマドキの高校生でも、AIはヤバいって、規制しないとまずいよ!って言ってるよ。

ティックトックでも笑えない動画が多い。+3

-0

-

128. 匿名 2025/07/16(水) 07:47:27

>>13

ほんとに。それに画像って一度出てしまうとどこかで保存されて消せないことも多い。もっと厳罰化しないといけないのにね。+8

-0

-

129. 匿名 2025/07/16(水) 07:50:49

>>116

恐ろしいのは被害者が逆に退学になることだって想定されるってことよな

AIなのかどうか見分けがつかない

クソ男どもが言い逃れのために「作ってない、ネットに落ちてた画像です、〇〇さんがヌードを自分で撮ってるだけ、パパ活の一環としてヌード売ってるらしいですよ」とか言われたら被害者のはずの〇〇さんが自分でノリノリでヌード晒してることになりかねない

AI規制の議論を続けると同時に「AI表示義務付け」くらいは今すぐやらなきゃいけない+10

-0

-

130. 匿名 2025/07/16(水) 07:56:22

>>41

女の子のYouTuberとか裸に加工されて動画作られたりしてるよね

くれまぐとかばんばんざいのるなとか流れてきたことある+2

-0

-

131. 匿名 2025/07/16(水) 07:56:27

卒アルで自分が載せてなくても

誰かに撮られて加工されて載せられたら

もう最悪だよね

全然ありえるからこわい+2

-0

-

132. 匿名 2025/07/16(水) 07:56:44

こういうことになると分かりきってたよね

もっとエグいのもあるはず+3

-0

-

133. 匿名 2025/07/16(水) 07:58:09

>>3

SNSだけでなく町中で隠し撮りされる場合もあるから、ホント気をつけようがないよ

以前コンビニで女子中学生を撮ってる感じの男の人いたけどああいうのもちょっと声掛けしたほうが良いのかなー

+11

-0

-

134. 匿名 2025/07/16(水) 07:58:51

教員の盗撮グループでもこれやってたみたいね

そこで初めて知ったわ+3

-0

-

135. 匿名 2025/07/16(水) 07:59:26

>>53

ガル男がこの記事見て使ってみよ〜とか考えそうだからアプリ名の入ったものは載せない方がいいんじゃない?+2

-0

-

136. 匿名 2025/07/16(水) 08:00:31

>>6

こういうのやってるのも男性なのかな?

女性でやってる人はいないんだろうか、まあいないねー協力してる人はおるかもしれないけど+6

-1

-

137. 匿名 2025/07/16(水) 08:01:51

>>34

本当に多すぎるよね、Yahooニュースパって開いたら必ずあるもの、それだけ多いってことなんだろうけど朝から嫌な気持ちになる+4

-0

-

138. 匿名 2025/07/16(水) 08:06:00

>>16

うちの子供が通う学校は事前にブログに載せても良いかアンケートを取られて、なおかつブログに載っても顔はモザイク並みにぼやけた感じだよ。+5

-1

-

139. 匿名 2025/07/16(水) 08:08:41

>>34

鞭打ち公開してやればいいよね

見せしめってバカには効くと思う

性犯罪者の人権なんてクソ喰らえ+12

-0

-

140. 匿名 2025/07/16(水) 08:10:35

>>129

色々最先端が行き過ぎると、こういう弊害も出てくるんだよな

便利さよりも、アナログに戻した方がいいんだよ本当は

恐ろしすぎる+6

-0

-

141. 匿名 2025/07/16(水) 08:13:21

>>133

ヨコ

わかる、最近勝手に人の顔写真とるような奴いるよね

みんな冬場もサングラスしたりして顔晒さないほうがいいよ

ほんと被害に遭っている人いると思うよ知らないだけで+11

-0

-

142. 匿名 2025/07/16(水) 08:14:43

老若男女関係なくアイコラなんて何十年も前からあったろうに+1

-4

-

143. 匿名 2025/07/16(水) 08:16:12

うちの子供、中学生なんだけどクラスLINEとかもやらないし、インスタもやってない。

けど、同級生がインスタに我が子をアップしたらしい。

親何してんだよ!本当バカにスマホ与えんな!+3

-0

-

144. 匿名 2025/07/16(水) 08:18:05

>>1

街を歩いているだけで

電車に乗ってるだけで

「女」というだけで撮られるよ

勝手にスマホカメラで写真を撮られる

だから、常にマスク着用は必須

+3

-2

-

145. 匿名 2025/07/16(水) 08:29:39

>>17

確かに注意すべきだし良くないとは思うけど、この件に関してはそういう画像を作るほうが悪いってかそんな物を作れてしまうような(あきらかにやるやついそうなのに)ツールを作る人の方が悪いのでは?

生成AIは性的な物は作れないよう管理を厳しくするべきだと思うけど。+4

-0

-

146. 匿名 2025/07/16(水) 08:30:00

>>27

5万以下!?

こいつらがいくら稼いでると思ってんだよ。意味ないよ。+5

-0

-

147. 匿名 2025/07/16(水) 08:36:25

>>4

数年前は女優(AV女優じゃない女優)のAIAV作成して捕まった人いたよね+6

-0

-

148. 匿名 2025/07/16(水) 08:39:12

>>11

またギャル男が潜り込んで

コメントしてるよ+1

-0

-

149. 匿名 2025/07/16(水) 08:45:08

>>101

盗撮はあった

私がトイレに入ろうとしてそこが汚かったから秒で出てきたらカメラ持った男が入ろうとした時あったよ+1

-0

-

150. 匿名 2025/07/16(水) 08:46:16

>>144

なんか異様に高い位置(向かい側の顔あたりに)で携帯持っている男性たまにいたりするけど、あれ怪しいよね

顔写真撮ってんのかなとか思う

女性は化粧ばっちりして可愛いくなった自分を曝け出して歩きたい気持ちは分かるけど今は危険だと思う

勝手に色々作られて勝手に晒される時代

だからサングラスあたりは本当はした方がいいと思う+4

-0

-

151. 匿名 2025/07/16(水) 08:46:21

>>16

幼稚園で、もちろん保護者から同意は得てるけどインスタに 行事の様子アップする時に子どもの顔載せる施設もあるらしいね+6

-0

-

152. 匿名 2025/07/16(水) 08:49:54

>>1

もう絶対に防げないところまで来た。

日常生活でも写真や動画を撮られたら、裏で出回ると思う。

どうなっていくのか想像がつかない。+4

-0

-

153. 匿名 2025/07/16(水) 08:52:26

>>2

俺見たい側だもん

by議員+10

-0

-

154. 匿名 2025/07/16(水) 08:54:39

>>1

テクノロジーはエロで普及する、みたいなのいい加減恥ずかしい+3

-0

-

155. 匿名 2025/07/16(水) 08:55:17

>>1

だから卒アルって嫌いなんだよね+3

-0

-

156. 匿名 2025/07/16(水) 08:56:55

>>3

本当にこれだよね

加工しまくって本当の顔はわからないだろうけど+1

-0

-

157. 匿名 2025/07/16(水) 08:57:04

>>1

実際の画像じゃなくて、AIでしょ?

無理矢理脱がされる事件になるよりも、性欲の先がAIになっていいんじゃない+2

-6

-

158. 匿名 2025/07/16(水) 09:05:25

>>133

キッズパークで遊んでたらエリアの外からスマホのレンズ向けてる男いた

睨んだらスマホの画面見られないようにスマホを体に寄せて離れていったし多分盗撮してた

未就学児向けの施設ですらこんな奴に遭遇するんだから街中いろんなところにいると思うわ+18

-0

-

159. 匿名 2025/07/16(水) 09:07:21

AIは「これは卒業アルバムの写真悪用にあたるので画像生成はできません」って断れ+6

-0

-

160. 匿名 2025/07/16(水) 09:11:04

>>4

昔から日本でも女性芸能人のアイコラ画像があった

それが技術が進歩して違和感ない画像に合成できてしまうって怖い+28

-0

-

161. 匿名 2025/07/16(水) 09:11:46

せめて顔だけでも合成できないような加工ができたらいいのに+5

-0

-

162. 匿名 2025/07/16(水) 09:12:53

変態共のせいで卒アル廃止になっちゃうのかな+1

-0

-

163. 匿名 2025/07/16(水) 09:15:58

>>29

文句あるなら辞めれば?+1

-6

-

164. 匿名 2025/07/16(水) 09:17:23

>>19

てかXにいる一部の男達が怖い

最近も「橋○環奈が弱者男性に○されたら面白いのになぁ」みたいな過激なポストしてた男がいて通報されてた。

他にも「可愛い若い女見ると無性にイライラする。どうせ俺のものにならないから。」みたいなポストにたくさんいいね付いてたり。

なんというか勝ち組女性や女性を憎む層がたくさんいて怖くなる。+12

-0

-

165. 匿名 2025/07/16(水) 09:17:30

>>49

だから文句あるなら辞めなって!

なんで一社員の不満で何ら不備の無い会社のシステム変えなきゃならんの?

あんた傲慢だよ!+0

-8

-

166. 匿名 2025/07/16(水) 09:17:42

>>151

うちの園は顔のせしますから同意書書いてねってなんか強制的に同意させられた…

+1

-2

-

167. 匿名 2025/07/16(水) 09:26:13

>>14

マイナス覚悟だけど、卒アル要らなくない?

私は学校嫌いでも無かったけど、自分のも全く見ない派。

子供の写真は、家族内でガンガン撮ってるし、学校生活のは別に要らん。+41

-4

-

168. 匿名 2025/07/16(水) 09:29:30

>>166

横

私それ同意しませんにした

そしたら連絡アプリの活動写真に載せないでくれたよ

+7

-1

-

169. 匿名 2025/07/16(水) 09:34:59

>>133

町中に盗撮してる人いるよね

XやYouTubeみてると優先席座ってる人、電車内で日焼け止め塗ってる人、ちょっと性的に見える人が顔出しでバンバン晒されてるよ+7

-0

-

170. 匿名 2025/07/16(水) 09:36:24

>>3

自分の顔は載せずに子供載せてるアホ親とか子供の危険より自分の承認欲求の毒親だわ+7

-0

-

171. 匿名 2025/07/16(水) 09:37:20

>>72

男子ですよ

こいつ男だろうなぁ+6

-0

-

172. 匿名 2025/07/16(水) 09:38:47

>>145

AIない時代でも裸の写真と照らし合わせて楽しむ変態はいたからねえ

AIなくなったらアナログな方法に戻すだけだから、子供の安全考えるなら写真なんか載せない方がいい+4

-0

-

173. 匿名 2025/07/16(水) 09:38:51

>>16

表彰とか作品展とかに顔名前乗るのはどう思う?

SNSには一切載せない派なんだけど、今度子供の作品が県規模で表彰されることになって…

本来なら顔も名前も出したくないけど、子供からすると自信にもなるだろうし嬉しいだろうなぁ…って。。+10

-0

-

174. 匿名 2025/07/16(水) 09:41:47

>>46

70代の爺さん婆さんもSNSに自分や家族の写真載せてる人多いよ〜

+7

-0

-

175. 匿名 2025/07/16(水) 09:44:40

>>169

優先席って別に座るのは問題ないんだよね本来

近くにお年寄りきたりしたら譲れば良いだけであって+7

-1

-

176. 匿名 2025/07/16(水) 09:44:59

>>17

私の元友人は、小学生女児の上半身裸をアップしてたよ。インスタは削除してるけど、この間ひっさしぶりにfacebook開いたら出てきた。前にfacebookとインスタ同期してたから、多分インスタでも見られるようにしてるはず。小学校の制服とか名前とか本名も晒してるのに、馬鹿としか思えなかった+7

-0

-

177. 匿名 2025/07/16(水) 09:45:21

>>93

勝手に撮ってSNSに勝手に載せるのは教師だけじゃないよ

嫌な時代になったな+5

-0

-

178. 匿名 2025/07/16(水) 09:47:03

>>176

男の子だと性器も載せる人いるよね

そういうの性的虐待で逮捕出来ないのかな+3

-0

-

179. 匿名 2025/07/16(水) 09:47:22

>>164

ヨコ

それだけブサや非モテ男が多いってことか

やっぱり妬む奴って男女ともにアレな奴ばかりだよね

人の事を妬んだって仕方ないし、ますます卑屈にも醜くなっていくだけなのにね+6

-0

-

180. 匿名 2025/07/16(水) 09:52:16

>>141

大人はサングラスいいけど、小中学生どうする?って感じだよね、この暑い中マスクは暑いし……ホント面倒くさいことさせるわ+4

-0

-

181. 匿名 2025/07/16(水) 09:52:47

>>173

横

それ悩んだけど地域の新聞、ネットニュースにインタビューと顔写真載せちゃったよ…

子供がとても努力していた分野だしなかなか断りづらかった

本人が喜んでたし難しいところだよね+10

-0

-

182. 匿名 2025/07/16(水) 09:54:40

>>158

スマホのレンズ向けるならまだわかりやすいけど、インカメで写るようにして隠し撮りしてる人もいるみたいだからわかりにくいよねー

画面見るとその人も映りつつ周りも映してるし、もし盗撮ならやり方がダサいなぁって思うわ+4

-0

-

183. 匿名 2025/07/16(水) 09:54:47

>>75

それ良いね!法整備が遅いのは、進めてる男達がか自分は男だし被害者にならないって思ってるからだろうしね。+17

-1

-

184. 匿名 2025/07/16(水) 09:56:16

>>37

何か鎖骨へんだね+1

-0

-

185. 匿名 2025/07/16(水) 09:59:20

>>142

アイコラは文字通り芸能人が対象

見たら分かるレベルにコラだったし

一般人や未成年とは違う+3

-0

-

186. 匿名 2025/07/16(水) 10:01:24

どうでもええよね

逆に今は本物でもAIかなあって言えるw+4

-1

-

187. 匿名 2025/07/16(水) 10:07:43

>>14

なんか盗撮とかで勝手に作られそうな気がしてきたわ

+3

-0

-

188. 匿名 2025/07/16(水) 10:08:50

>>64

パワハラ・セクハラによる鬱発症・引きこもりの発生みたいな企業加害案件すら断罪体制が整ってないのに

10年以上前からあるパワハラ問題から後に出てきたこの問題にまで手をまわすなんてあと何百年かかるんだ+0

-0

-

189. 匿名 2025/07/16(水) 10:10:13

加害者のディープフェイクでBL作る+2

-0

-

190. 匿名 2025/07/16(水) 10:15:13

>>118

そう、性欲というより征服欲そのもの

動物をあやめて写真見せ合うのと同じという意見、よくわかるよ

だからネット広告で出てくる気持ち悪い漫画も単純なエロじゃなくて女を涙目にさせてたりするやつばかり

孕ませ、キモいオッサンが女児を障害が残るように汚す、BBAにやりたい放題的な酷いやつ

とにかく欲望がなんかおかしい+17

-0

-

191. 匿名 2025/07/16(水) 10:15:59

>>189

それ作られても……+2

-0

-

192. 匿名 2025/07/16(水) 10:16:00

>>160

アイコラあったね。+5

-0

-

193. 匿名 2025/07/16(水) 10:17:12

未来ある子供の人生を潰すんだから即死刑でいいよ+0

-1

-

194. 匿名 2025/07/16(水) 10:18:28

>>190

女性をモノとしか見てないんだよ。

男がエロと感じることの7割はコンプレックスの裏返しみたいな感じ+12

-0

-

195. 匿名 2025/07/16(水) 10:22:39

>>179

でも本人は妬みだって認めないよね

高校野球の慶応高校も「親ガチャに当たっただけの子達だから応援できない」てコメントにプラス沢山ついてて怖い

妬みだとも認めないし+6

-1

-

196. 匿名 2025/07/16(水) 10:23:18

>>164

Xだと『11万人のアンチフェミニスト素晴らしい』から始まるやつも怖かった

ポス主炎上して凍結されたけど検索すれば転載が出てくる+6

-0

-

197. 匿名 2025/07/16(水) 10:23:48

>>185

でも今は一般人や未成年もSNSで全世界に発信する人多いよね+3

-0

-

198. 匿名 2025/07/16(水) 10:25:50

>>133

SNSに周りの人達も映り込んでるのに構わず載せる人いるよね+8

-0

-

199. 匿名 2025/07/16(水) 10:28:23

>>170

でもそういう親に限って良い親ぶるよね

子供を愛してますアピールが凄いもん

+5

-0

-

200. 匿名 2025/07/16(水) 10:30:20

>>185

芸能人相手に何してもいいってわけでもないでしょ+2

-0

-

201. 匿名 2025/07/16(水) 10:31:54

SNSに載せる人って自信満々のナルシストなの?

私ブスすぎて載せられないよ〜+3

-1

-

202. 匿名 2025/07/16(水) 10:36:47

>>52

捨てた

知らんやつとかと写ってても

勝手に悪用するのも多いし

+4

-1

-

203. 匿名 2025/07/16(水) 10:50:27

>>181

子供からしたら嬉しいもんだよね…

親も単純に喜ばせてほしいよ、こんな時代のせいで色々考えちゃって素直に喜べないよ。。+10

-0

-

204. 匿名 2025/07/16(水) 10:58:43

さすがにAIは個人が生成するのは出来ない様にした方が良いと思う。作る人はとても頭が良いんだろうけどそれを世に放ったらどうなるかまで考えてほしいわ+5

-0

-

205. 匿名 2025/07/16(水) 10:59:19

>>204

作る人はってAI作った人のことです+1

-0

-

206. 匿名 2025/07/16(水) 11:05:41

子供だけじゃなくてがる子も気を付けなよ

熟女盗撮してる人いるから+2

-0

-

207. 匿名 2025/07/16(水) 11:51:37

>>174

爺さん婆さんが孫の女子高生の制服姿を載せてたりすると悪用されるから絶対辞めるべき+7

-0

-

208. 匿名 2025/07/16(水) 11:54:31

>>10

これからどんどん精巧になっていくからだいじょうぶじゃないの+4

-1

-

209. 匿名 2025/07/16(水) 12:18:43

>>157

じゃああなたの顔に差し替えられた

裸でM字開脚の画像が

あなたの知らないところでバラまかれ

卑猥な言葉を添えられていても平気なの?+11

-0

-

210. 匿名 2025/07/16(水) 12:34:15

>>32

ホントそれ

SNSに自分の子供の写真や動画アップする人まだいるけど

大人だけじゃない赤ちゃんまでコラ作って性的な嗜好に利用してるのあるからね+13

-0

-

211. 匿名 2025/07/16(水) 12:37:49

>>23

エロは世界を平和にする

逆だよ

犯罪を起こすじゃん

なんでこう男って「自分は望まれてる」前提なの?

お前たちの性欲、望んでませんからって思うんだけど

こっちは望まないので、何かしてきたら犯罪になる

性犯罪を起こすことによって女性が傷ついて、どの辺が「平和」なの?

理解できん+15

-1

-

212. 匿名 2025/07/16(水) 12:52:27

>>190

男が得てるのは女を使った連帯感とか万能感なのではと思うことがある。別に誰かと繋がることや何か満たされたいと思うのは皆あるし悪くないけど、彼らはそれを得る為の手段が悪質過ぎるよね。+13

-0

-

213. 匿名 2025/07/16(水) 12:53:02

>>3

昔だからなかった?

SNSインフルエンサーが、風俗かパパ活アプリに顔を載せられて訴えたってなんかで見たことある+7

-0

-

214. 匿名 2025/07/16(水) 13:00:31

>>211

女の平和という古代ギリシアの喜劇が元になった考え方なのですかな?+3

-2

-

215. 匿名 2025/07/16(水) 13:08:31

イジメにも使われるのでは??良くないぞコレは

+4

-0

-

216. 匿名 2025/07/16(水) 13:09:49

性的画像作られたぶんだけ加害者から被害者にお金がいくようにしてほしい。ネット上から消えないならお金もらい続けてほしい。それくらいしないとあまりに理不尽。+2

-1

-

217. 匿名 2025/07/16(水) 13:41:15

>>153

件数の割に性犯罪が本当に甘すぎてもうこう言うことだとしか思えん+8

-0

-

218. 匿名 2025/07/16(水) 14:12:05

>>3

娘の私立保育園、インスタで園の様子を載せてるよ。

私は写真公開NGにしたけど、親がOKにした子の顔がバッチリ写ってる。

やっぱちょっと危ないよね。

+15

-0

-

219. 匿名 2025/07/16(水) 14:17:50

>>6

スカート捲りとかいまだにあるらしいね。私の時代は男子がパイカンって言いながらすれ違いざまに胸触ってくるやつが流行ってた。気持ち悪い。

男子とすれ違う時はみんな胸守ってたりしたけど今だったら大問題になってたな。ちなみにアラサー+11

-0

-

220. 匿名 2025/07/16(水) 15:26:28

卒アルっていらなくない?+4

-0

-

221. 匿名 2025/07/16(水) 15:29:55

>>213

2ちゃんねるに顔写真転載してH大好きみたいな嘘八百文と本人の名前やら載せて回る迷惑行為は昔からある+8

-0

-

222. 匿名 2025/07/16(水) 15:31:30

>>216

それはどうだろう

性暴力の示談みたいに「金もらったんだからいいだろ」「金目当て」みたいなセカンドレイプが横行しそう+0

-0

-

223. 匿名 2025/07/16(水) 15:34:09

技術の進歩も医療の進歩も悪い事もあるよね。

こんなん、被害どころじゃないじゃん、写真や画像1枚でも簡単に使えるのに、いつ被害者になるか分からんよ、、

防ぎようもないし、、+4

-0

-

224. 匿名 2025/07/16(水) 16:00:43

>>118

女同士って有益な情報を共有して助け合ったりするけど、男同士が協力するのってエロ情報だけだよね+12

-0

-

225. 匿名 2025/07/16(水) 17:46:34

>>1

YouTubeの画像もやばいよ+1

-0

-

226. 匿名 2025/07/16(水) 18:49:36

>>214

何言ってるの?

望んでると思い込んだ性被害なんて害でしかないでしょうよ

+5

-0

-

227. 匿名 2025/07/16(水) 18:50:33

>>3

誰かの写真に写り込んでたり、卒アルとか普通の写真も悪用されるかもしれない今の時代、恐ろしいよね

AIを一般人が簡単に使えるようにする前に法律で悪用禁じるべきだった+4

-0

-

228. 匿名 2025/07/16(水) 18:56:05

記事中の「見ず知らずのうちに写真が悪用され」って言葉に違和感があるんだけど、日本語正しい?

あとこれこども家庭庁の仕事ではないような。

被害は子どもだけじゃない。

+1

-0

-

229. 匿名 2025/07/16(水) 18:58:14

そんなの気にする方がおかしい

AIはAI

昔からアイコラのようなものはあった+0

-0

-

230. 匿名 2025/07/16(水) 19:00:09

+0

-2

-

231. 匿名 2025/07/16(水) 19:04:14

>>98

早くなくなりますように!!

今もなくなっている市区村町なかったっけ?+3

-0

-

232. 匿名 2025/07/16(水) 19:08:02

>>230

子供達を食い物にする輩達のところに行かないかな。+6

-0

-

233. 匿名 2025/07/16(水) 19:11:02

>>5

チンコは、でしょ?

変な事だけ共同責任にすなよ。+4

-0

-

234. 匿名 2025/07/16(水) 19:20:02

脱法児童ポルノまじかよ

めっちゃシコるわ+0

-2

-

235. 匿名 2025/07/16(水) 19:25:48

>>65

でも男性は絶対死んでくれないから女性たちがせーので集団自決が現実的かも。1人でも残ったら酷い目にあうから確実に死ねる薬とかほしいよね。+3

-6

-

236. 匿名 2025/07/16(水) 20:50:26

>>2

さすがに個人が端末で生成して楽しむ権利まで規制はできないと思う

好きな子の裸姿を想像してオナるだけで罪に問われるようなおかしな議論になりかねない+0

-0

-

237. 匿名 2025/07/16(水) 21:09:10

自分の想像を遥かに超えるおぞましい事する男って結構そのへんにウヨウヨしてるよな+1

-0

-

238. 匿名 2025/07/16(水) 21:21:06

>>1

昔から、最新技術は戦争とポルノに真っ先に使われるって言葉があるよね。まさにその通り+2

-0

-

239. 匿名 2025/07/16(水) 21:24:34

>>163

言われなくてもどんどん辞めてるでしょ+0

-0

-

240. 匿名 2025/07/16(水) 21:28:58

>>29

少人数雇用側で管理団体に所属してるんだけど最近これは本当にそう思う

スタッフの身の安全を守れていますか?って

+2

-0

-

241. 匿名 2025/07/16(水) 21:30:44

>>236

そうなんだ

じゃああなたの顔写真を提供してあげて楽しんでいただいてくださいね+2

-0

-

242. 匿名 2025/07/16(水) 21:30:49

>>236

個人の楽しみと思ってパソコンに保存してた彼女の裸体も名前も職場も拡散された過去の悲劇をご存知?

公務員だったのにそこの県に居られなくなったんだよ+2

-0

-

243. 匿名 2025/07/16(水) 21:37:49

>>236

まともな会社が開発したAIモデルはアダルトや著名人のディープフェイクと判断したものは通常は出力しないように規制がかかってる

個人ユースであってもリスキーな出力をわざとやってる悪質なモデルを取り締まることは必要になってくるでしょうね

頭で裸の想像をするのと、個人の顔写真に依拠して出力した上簡単に複製や領分できてしまうデータを作成するのとでは全然違うことだから+1

-0

-

244. 匿名 2025/07/16(水) 22:00:31

>>1

佳子さまの水着姿とか沢山出てくるんですけど。+0

-0

-

245. 匿名 2025/07/16(水) 22:09:35

おまえらには関係のない話だよ+0

-0

-

246. 匿名 2025/07/16(水) 22:31:04

>>34

新宿駅に置いて石投よう+0

-0

-

247. 匿名 2025/07/16(水) 22:36:08

threadでこの写真を加工してくださいって依頼する人いるけど、大丈夫なんかなって思う。

+0

-0

-

248. 匿名 2025/07/16(水) 22:49:22

可愛い我が子をネット上で晒して、注目を集め、更にお金も集めてる親いるね。

世界中で見られ、性の餌食になってるんだね、お子さん。+2

-0

-

249. 匿名 2025/07/16(水) 23:12:27

>>40

アメリカだったかな。レイプ犯の脳ミソを調べたら、普通の人と脳の構造が一部違ってたって報道がされてた。…てことはもう一生治らないよね。だから再犯率も高いんだろう。

犠牲者を増やしたくないなら、レイプ犯は死刑にするしかないと思う。+2

-0

-

250. 匿名 2025/07/16(水) 23:29:15

>>217

性犯罪の判決が甘い場合も裁判官も性犯罪者として見てしまう。いつかこいつもやるんだろうなだから甘いんだろうなって。+1

-0

-

251. 匿名 2025/07/16(水) 23:33:35

>>88

恐怖心植え付けても何も良いことない。

支配欲ってとても醜いと思う。

「本当に男ってバカだね」これで終わる。+0

-0

-

252. 匿名 2025/07/16(水) 23:49:15

>>119

>「こんなことしちゃダメだよ」って嗜める男性はかなり少ない

私が日本男性を恋愛対象から外した理由の一つがこれ

キモい犯罪者やロリコンだけが悪いんじゃない

そういうロリペド鬼畜を同性である男性が放置、あるいは理解していることが許せない

「自分はロリじゃないけど、世間の男は小中学生が好きでしょ」みたいに思ってる普通の男が溢れている

海外ではあり得ないよ

海外の普通の男たちはそういうロリペド鬼畜を許さない+2

-1

-

253. 匿名 2025/07/16(水) 23:51:35

>>37

普通の人だと気になるけど変質者は細かいとこ見ないんだと思う+0

-0

-

254. 匿名 2025/07/16(水) 23:51:42

>>216

それじゃあ足りないし、端金もらったところで「お金もらってるんだから良いでしょ」と割り引かれるのは嫌だな

それより死刑にしてほしい

犯人の家族も連座とか

じゃなきゃ家族も監視しないから+0

-0

-

255. 匿名 2025/07/16(水) 23:59:46

>>51

日本の男はボンッキュッバーンッな峰不二子が怖いんでしょ

自分に自信がないから

だから幼さを売りにする多人数アイドルとか子役に目が行くみたい+6

-0

-

256. 匿名 2025/07/17(木) 01:23:42

>>49

知ってる会社の話だけど近影を必ず掲載することって通達が出た数日後に撤回と謝罪が出たよ

ここには詳しく書けないけどやり方によっては肖像権の侵害に該当する可能性があるのではとタレコミでもあったんじゃないかなぁ

+3

-0

-

257. 匿名 2025/07/17(木) 08:33:19

>>65

少子化進むわけだわw+0

-0

-

258. 匿名 2025/07/17(木) 10:15:47

>>219

アラサー!?

そんなのがあるなんてびっくり

ちなみに地方ですか?+0

-0

-

259. 匿名 2025/07/17(木) 12:17:09

>>224

そう結局どれだけの獲物を提示できたかでマウントとりながら、どれだけエロく見れるかで連帯感示してるよね。+1

-0

-

260. 匿名 2025/07/17(木) 13:28:25

>>6

昔からコラージュはあった。

アイドルだけじゃなく同級生。

+0

-0

-

261. 匿名 2025/07/17(木) 14:58:10

>>258

いえ、東京です。うちの中学の男子が異様だったのかも。一部の男子の間で流行ってた感じです+1

-0

-

262. 匿名 2025/07/17(木) 17:10:36

>>261

そうなんだ…

大変でしたね+1

-0

-

263. 匿名 2025/07/17(木) 19:18:40

>>256

管理のためだけなら全社員が閲覧できる場所への掲載は必要ないわけだし

コミュニケーション目的なのであれば業務上必須とする理由としては成立しない

個人情報保護やプライバシーの観点からそこ指摘されたら会社としては引き下がらざるを得なかったんだろうね

誰か従業員の中で賢明な方がしかるべき方法で指摘したんだろうな

管理側にそういった賢明な方がいないのは残念。。。+1

-0

-

264. 匿名 2025/07/17(木) 19:24:14

>>240

卒アルで起きてるようなことが社員録でも起きかねないわけだよね

組織なんか妬み嫉みの場所なんだからAI関係なく顔写真の悪用なんて簡単に想像できるし

危機管理能力低すぎな管理職、組織が心配だよね

冗談抜きでそういう会社とは早めにバイバイするに限るね+0

-0

-

265. 匿名 2025/07/18(金) 02:08:21

+0

-0

-

266. 匿名 2025/07/23(水) 21:23:13

>>88

男は頭悪いからダメなんだよ。+1

-0

コメントを投稿する

トピック投稿後31日を過ぎると、コメント投稿ができなくなります。削除すべき不適切なコメントとして通報しますか?

いいえ

通報する

今、急増しているディープフェイクによる性的被害。